teoria komunikacji Shannona.pdf

teoria komunikacji Shannona.pdf teoria komunikacji Shannona.pdf

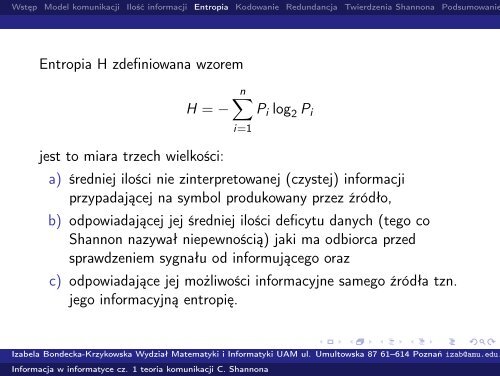

Wstęp Model komunikacji Ilość informacji Entropia Kodowanie Redundancja Twierdzenia Shannona Podsumowanie Entropia H zdefiniowana wzorem H = − jest to miara trzech wielkości: n∑ P i log 2 P i i=1 a) średniej ilości nie zinterpretowanej (czystej) informacji przypadającej na symbol produkowany przez źródło, b) odpowiadającej jej średniej ilości deficytu danych (tego co Shannon nazywał niepewnością) jaki ma odbiorca przed sprawdzeniem sygnału od informującego oraz c) odpowiadające jej możliwości informacyjne samego źródła tzn. jego informacyjną entropię. Izabela Bondecka-Krzykowska Wydział Matematyki i Informatyki UAM ul. Umultowska 87 61–614 Poznań izab@amu.edu. Informacja w informatyce cz. 1 teoria komunikacji C. Shannona

Wstęp Model komunikacji Ilość informacji Entropia Kodowanie Redundancja Twierdzenia Shannona Podsumowanie symbol - zdarzenie - komunikat Izabela Bondecka-Krzykowska Wydział Matematyki i Informatyki UAM ul. Umultowska 87 61–614 Poznań izab@amu.edu. Informacja w informatyce cz. 1 teoria komunikacji C. Shannona

- Page 23 and 24: Wstęp Model komunikacji Ilość in

- Page 25 and 26: Wstęp Model komunikacji Ilość in

- Page 27 and 28: Wstęp Model komunikacji Ilość in

- Page 29 and 30: Wstęp Model komunikacji Ilość in

- Page 31 and 32: Wstęp Model komunikacji Ilość in

- Page 33 and 34: Wstęp Model komunikacji Ilość in

- Page 35 and 36: Wstęp Model komunikacji Ilość in

- Page 37 and 38: Wstęp Model komunikacji Ilość in

- Page 39 and 40: Wstęp Model komunikacji Ilość in

- Page 41 and 42: Wstęp Model komunikacji Ilość in

- Page 43 and 44: Wstęp Model komunikacji Ilość in

- Page 45 and 46: Wstęp Model komunikacji Ilość in

- Page 47 and 48: Wstęp Model komunikacji Ilość in

- Page 49 and 50: Wstęp Model komunikacji Ilość in

- Page 51 and 52: Wstęp Model komunikacji Ilość in

- Page 53 and 54: Wstęp Model komunikacji Ilość in

- Page 55 and 56: Wstęp Model komunikacji Ilość in

- Page 57 and 58: Wstęp Model komunikacji Ilość in

- Page 59 and 60: Wstęp Model komunikacji Ilość in

- Page 61 and 62: Wstęp Model komunikacji Ilość in

- Page 63 and 64: Wstęp Model komunikacji Ilość in

- Page 65 and 66: Wstęp Model komunikacji Ilość in

- Page 67 and 68: Wstęp Model komunikacji Ilość in

- Page 69 and 70: Wstęp Model komunikacji Ilość in

- Page 71 and 72: Wstęp Model komunikacji Ilość in

- Page 73: Wstęp Model komunikacji Ilość in

- Page 77 and 78: Wstęp Model komunikacji Ilość in

- Page 79 and 80: Wstęp Model komunikacji Ilość in

- Page 81 and 82: Wstęp Model komunikacji Ilość in

- Page 83 and 84: Wstęp Model komunikacji Ilość in

- Page 85 and 86: Wstęp Model komunikacji Ilość in

- Page 87 and 88: Wstęp Model komunikacji Ilość in

- Page 89 and 90: Wstęp Model komunikacji Ilość in

- Page 91 and 92: Wstęp Model komunikacji Ilość in

- Page 93 and 94: Wstęp Model komunikacji Ilość in

- Page 95 and 96: Wstęp Model komunikacji Ilość in

- Page 97 and 98: Wstęp Model komunikacji Ilość in

- Page 99 and 100: Wstęp Model komunikacji Ilość in

- Page 101 and 102: Wstęp Model komunikacji Ilość in

- Page 103 and 104: Wstęp Model komunikacji Ilość in

- Page 105 and 106: Wstęp Model komunikacji Ilość in

- Page 107 and 108: Wstęp Model komunikacji Ilość in

- Page 109 and 110: Wstęp Model komunikacji Ilość in

- Page 111 and 112: Wstęp Model komunikacji Ilość in

- Page 113 and 114: Wstęp Model komunikacji Ilość in

- Page 115 and 116: Wstęp Model komunikacji Ilość in

- Page 117 and 118: Wstęp Model komunikacji Ilość in

- Page 119 and 120: Wstęp Model komunikacji Ilość in

- Page 121 and 122: Wstęp Model komunikacji Ilość in

- Page 123 and 124: Wstęp Model komunikacji Ilość in

Wstęp Model <strong>komunikacji</strong> Ilość informacji Entropia Kodowanie Redundancja Twierdzenia <strong>Shannona</strong> Podsumowanie<br />

Entropia H zdefiniowana wzorem<br />

H = −<br />

jest to miara trzech wielkości:<br />

n∑<br />

P i log 2 P i<br />

i=1<br />

a) średniej ilości nie zinterpretowanej (czystej) informacji<br />

przypadającej na symbol produkowany przez źródło,<br />

b) odpowiadającej jej średniej ilości deficytu danych (tego co<br />

Shannon nazywał niepewnością) jaki ma odbiorca przed<br />

sprawdzeniem sygnału od informującego oraz<br />

c) odpowiadające jej możliwości informacyjne samego źródła tzn.<br />

jego informacyjną entropię.<br />

Izabela Bondecka-Krzykowska Wydział Matematyki i Informatyki UAM ul. Umultowska 87 61–614 Poznań izab@amu.edu.<br />

Informacja w informatyce cz. 1 <strong>teoria</strong> <strong>komunikacji</strong> C. <strong>Shannona</strong>