ÑоÑÐ¼Ð°Ñ Adobe PDF, ÑÐ°Ð·Ð¼ÐµÑ 2173 Ðб - ÐнÑоÑмаÑионно ...

ÑоÑÐ¼Ð°Ñ Adobe PDF, ÑÐ°Ð·Ð¼ÐµÑ 2173 Ðб - ÐнÑоÑмаÑионно ... ÑоÑÐ¼Ð°Ñ Adobe PDF, ÑÐ°Ð·Ð¼ÐµÑ 2173 Ðб - ÐнÑоÑмаÑионно ...

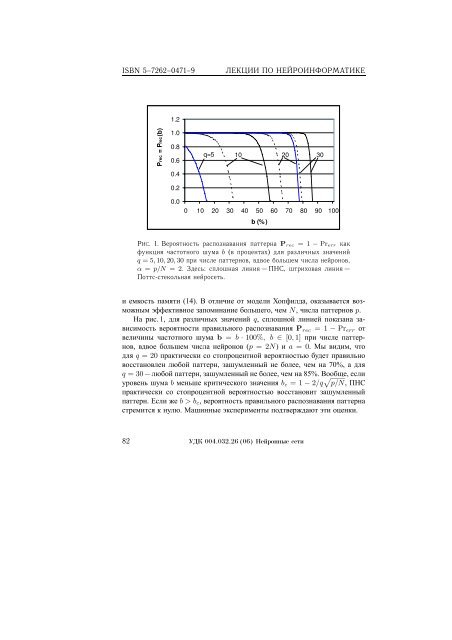

ISBN 5–7262–0471–9ЛЕКЦИИ ПО НЕЙРОИНФОРМАТИКЕPrec = Prec(b)1.21.00.80.60.40.20.0q=5 10 20 300 10 20 30 40 50 60 70 80 90 100b (%)РИС. 1. Вероятность распознавания паттерна P rec = 1 − Pr err какфункция частотного шума b (в процентах) для различных значенийq = 5, 10, 20, 30 при числе паттернов, вдвое большем числа нейронов,α = p/N = 2. Здесь: сплошная линия — ПНС, штриховая линия —Поттс-стекольная нейросеть.и емкость памяти (14). В отличие от модели Хопфилда, оказывается возможнымэффективное запоминание большего, чем N, числа паттернов p.На рис. 1, для различных значений q, сплошной линией показана зависимостьвероятности правильного распознавания P rec = 1 − Pr err отвеличины частотного шума b = b · 100%, b ∈ [0, 1] при числе паттернов,вдвое большем числа нейронов (p = 2N) и a = 0. Мы видим, чтодля q = 20 практически со стопроцентной вероятностью будет правильновосстановлен любой паттерн, зашумленный не более, чем на 70%, а дляq = 30 — любой паттерн, зашумленный не более, чем на 85%. Вообще, еслиуровень шума b меньше критического значения b c = 1 − 2/q √ p/N, ПНСпрактически со стопроцентной вероятностью восстановит зашумленныйпаттерн. Если же b > b c , вероятность правильного распознавания паттернастремится к нулю. Машинные эксперименты подтверждают эти оценки.82 УДК 004.032.26 (06) Нейронные сети

Б. В. КРЫЖАНОВСКИЙ, Л. Б. ЛИТИНСКИЙАналогично можно оценить емкость памяти Поттс-стекольной нейросети.Проводя вычисления, подобные тем, что делались выше, для рандомизированногонабора паттернов получим:[Pr err = N exp − N ]q(q − 1)(1 −2p 2¯b) 2 q, ¯b =q − 1 b , (15)p c =N q(q − 1)(1 −2 ln N 2¯b) 2 . (16)При q = 2 эти выражения переходят в известные оценки для модели Хопфилда.В то же время, при q ≫ 1 емкость памяти Поттс-стекольной нейросетив два раза меньше емкости памяти ПНС (ср. (16) с (14) при a = 0).Эта двойка становится существенной, когда речь заходит о помехоустойчивостисети — для вероятности неправильного распознавания эта двойкапопадает в показатель экспоненты (см. (13) и (15)), что ведет к заметномуснижению помехоустойчивости Поттс-стекольной модели по сравнению сПНС (особенно, в области умеренных значений q ∼ 10). Это хорошо виднона рис. 1, где для Поттс-стекольной модели штриховой линией показаназависимость вероятности правильного распознавания P rec от величинычастотного шума b при тех же условиях, что и для ПНС (сплошная линия).В заключение заметим, что в основе хороших емкостных характеристикобеих рассмотренных нами моделей лежит одно и тоже — высокая степеньфильтрации внутренних шумов как на стадии передачи сигналов по межсвязям,так и в процессе выполнения решающего правила. Это приводит куменьшению дисперсии внутреннего шума на величину порядка q 2 , что иобеспечивает успех. В других q-нарных моделях ассоциативной памяти такаяфильтрация полностью отсутствует. Более того, с ростом q все большедробится шкала, градуирующая различные состояния нейронов (см. (1)), ивсе меньше становится разница между двумя их различными состояниями.В то же время, дисперсия шума остается практически неизменной. Этои приводит к уменьшению емкости памяти этих моделей по сравнению смоделью Хопфилда.Работа выполнялась при финансовой поддержке РФФИ (гранты 02-01-00457 и 01-01-00090) и программы «Интеллектуальные компьютерныесистемы» (проект 2. 45).УДК 004.032.26 (06) Нейронные сети 83

- Page 32 and 33: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 34 and 35: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 36 and 37: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 38 and 39: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 40 and 41: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 42 and 43: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 44 and 45: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 46 and 47: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 48 and 49: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 50 and 51: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 52 and 53: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 54 and 55: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 56 and 57: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 58 and 59: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 60 and 61: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 62 and 63: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 64 and 65: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 66 and 67: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 68 and 69: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 70 and 71: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 72 and 73: Б. В. КРЫЖАНОВСКИЙ,

- Page 74 and 75: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 76 and 77: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 78 and 79: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 80 and 81: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 84 and 85: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 86 and 87: Н. Г. МАКАРЕНКОИнст

- Page 88 and 89: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 90 and 91: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 92 and 93: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 94 and 95: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 96 and 97: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 98 and 99: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 100 and 101: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 102 and 103: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 104 and 105: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 106 and 107: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 108 and 109: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 110 and 111: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 112 and 113: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 114 and 115: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 116 and 117: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 118 and 119: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 120 and 121: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 122 and 123: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 124 and 125: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 126 and 127: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 128 and 129: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

- Page 130 and 131: ISBN 5-7262-0471-9ЛЕКЦИИ ПО

ISBN 5–7262–0471–9ЛЕКЦИИ ПО НЕЙРОИНФОРМАТИКЕPrec = Prec(b)1.21.00.80.60.40.20.0q=5 10 20 300 10 20 30 40 50 60 70 80 90 100b (%)РИС. 1. Вероятность распознавания паттерна P rec = 1 − Pr err какфункция частотного шума b (в процентах) для различных значенийq = 5, 10, 20, 30 при числе паттернов, вдвое большем числа нейронов,α = p/N = 2. Здесь: сплошная линия — ПНС, штриховая линия —Поттс-стекольная нейросеть.и емкость памяти (14). В отличие от модели Хопфилда, оказывается возможнымэффективное запоминание большего, чем N, числа паттернов p.На рис. 1, для различных значений q, сплошной линией показана зависимостьвероятности правильного распознавания P rec = 1 − Pr err отвеличины частотного шума b = b · 100%, b ∈ [0, 1] при числе паттернов,вдвое большем числа нейронов (p = 2N) и a = 0. Мы видим, чтодля q = 20 практически со стопроцентной вероятностью будет правильновосстановлен любой паттерн, зашумленный не более, чем на 70%, а дляq = 30 — любой паттерн, зашумленный не более, чем на 85%. Вообще, еслиуровень шума b меньше критического значения b c = 1 − 2/q √ p/N, ПНСпрактически со стопроцентной вероятностью восстановит зашумленныйпаттерн. Если же b > b c , вероятность правильного распознавания паттернастремится к нулю. Машинные эксперименты подтверждают эти оценки.82 УДК 004.032.26 (06) Нейронные сети