Ðа пÑÐ°Ð²Ð°Ñ ÑÑкопиÑи

Ðа пÑÐ°Ð²Ð°Ñ ÑÑкопиÑи

Ðа пÑÐ°Ð²Ð°Ñ ÑÑкопиÑи

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

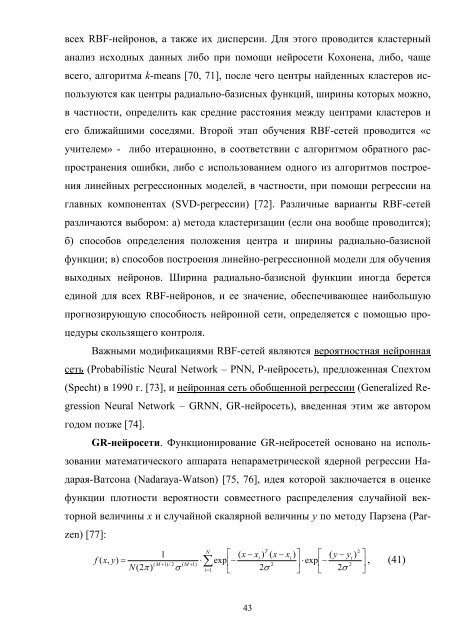

всех RBF-нейронов, а также их дисперсии. Для этого проводится кластерный<br />

анализ исходных данных либо при помощи нейросети Кохонена, либо, чаще<br />

всего, алгоритма k-means [70, 71], после чего центры найденных кластеров используются<br />

как центры радиально-базисных функций, ширины которых можно,<br />

в частности, определить как средние расстояния между центрами кластеров и<br />

его ближайшими соседями. Второй этап обучения RBF-сетей проводится «с<br />

учителем» - либо итерационно, в соответствии с алгоритмом обратного распространения<br />

ошибки, либо с использованием одного из алгоритмов построения<br />

линейных регрессионных моделей, в частности, при помощи регрессии на<br />

главных компонентах (SVD-регрессии) [72]. Различные варианты RBF-сетей<br />

различаются выбором: а) метода кластеризации (если она вообще проводится);<br />

б) способов определения положения центра и ширины радиально-базисной<br />

функции; в) способов построения линейно-регрессионной модели для обучения<br />

выходных нейронов. Ширина радиально-базисной функции иногда берется<br />

единой для всех RBF-нейронов, и ее значение, обеспечивающее наибольшую<br />

прогнозирующую способность нейронной сети, определяется с помощью процедуры<br />

скользящего контроля.<br />

Важными модификациями RBF-сетей являются вероятностная нейронная<br />

сеть (Probabilistic Neural Network – PNN, P-нейросеть), предложенная Спехтом<br />

(Specht) в 1990 г. [73], и нейронная сеть обобщенной регрессии (Generalized Regression<br />

Neural Network – GRNN, GR-нейросеть), введенная этим же автором<br />

годом позже [74].<br />

GR-нейросети. Функционирование GR-нейросетей основано на использовании<br />

математического аппарата непараметрической ядерной регрессии Надарая-Ватсона<br />

(Nadaraya-Watson) [75, 76], идея которой заключается в оценке<br />

функции плотности вероятности совместного распределения случайной векторной<br />

величины x и случайной скалярной величины y по методу Парзена (Parzen)<br />

[77]:<br />

N<br />

T<br />

1<br />

⎡ ( x − x ⎤ ⎡<br />

i<br />

) ( x − xi<br />

) −<br />

= ⋅∑<br />

⎢−<br />

⎥ ⋅ ( y yi<br />

)<br />

( x,<br />

y)<br />

exp<br />

exp⎢−<br />

( M + 1) / 2 ( M + 1)<br />

2<br />

2<br />

N(2π<br />

) σ i=<br />

1 ⎣ 2σ<br />

⎦ ⎣ 2σ<br />

f , (41)<br />

2<br />

⎤<br />

⎥<br />

⎦<br />

43