Ðа пÑÐ°Ð²Ð°Ñ ÑÑкопиÑи

Ðа пÑÐ°Ð²Ð°Ñ ÑÑкопиÑи

Ðа пÑÐ°Ð²Ð°Ñ ÑÑкопиÑи

You also want an ePaper? Increase the reach of your titles

YUMPU automatically turns print PDFs into web optimized ePapers that Google loves.

строится кубическая интерполяция, и ее минимум выбирается в качестве новой<br />

оптимальной точки. Этот процесс продолжается до тех пор, пока не будет достигнуто<br />

существенное уменьшение функционала ошибки.<br />

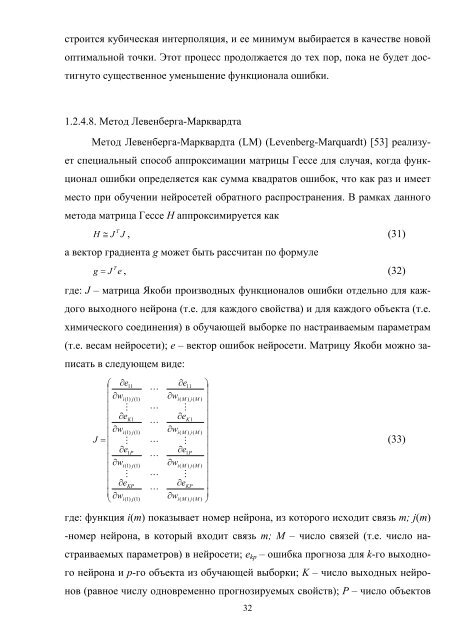

1.2.4.8. Метод Левенберга-Марквардта<br />

Метод Левенберга-Марквардта (LM) (Levenberg-Marquardt) [53] реализует<br />

специальный способ аппроксимации матрицы Гессе для случая, когда функционал<br />

ошибки определяется как сумма квадратов ошибок, что как раз и имеет<br />

место при обучении нейросетей обратного распространения. В рамках данного<br />

метода матрица Гессе H аппроксимируется как<br />

T<br />

H ≅ J J , (31)<br />

а вектор градиента g может быть рассчитан по формуле<br />

T<br />

g = J e , (32)<br />

где: J – матрица Якоби производных функционалов ошибки отдельно для каждого<br />

выходного нейрона (т.е. для каждого свойства) и для каждого объекта (т.е.<br />

химического соединения) в обучающей выборке по настраиваемым параметрам<br />

(т.е. весам нейросети); e – вектор ошибок нейросети. Матрицу Якоби можно записать<br />

в следующем виде:<br />

⎛ ∂e<br />

⎜<br />

⎜ ∂wi<br />

(1)<br />

⎜ M<br />

⎜ ∂eK<br />

⎜<br />

⎜<br />

∂wi<br />

(1)<br />

J = ⎜ M<br />

⎜ ∂e1<br />

⎜ ∂wi<br />

(1)<br />

⎜<br />

⎜ M<br />

⎜ ∂e<br />

⎜<br />

⎝ ∂wi<br />

(1)<br />

11<br />

j(1)<br />

1<br />

j(1)<br />

P<br />

j(1)<br />

KP<br />

j(1)<br />

L<br />

L<br />

L<br />

L<br />

L<br />

L<br />

L<br />

∂e<br />

∂wi<br />

( M )<br />

M<br />

∂eK<br />

∂wi<br />

( M )<br />

M<br />

∂e1<br />

∂wi<br />

( M )<br />

M<br />

∂e<br />

∂w<br />

11<br />

j(<br />

M )<br />

1<br />

j(<br />

M )<br />

P<br />

j(<br />

M )<br />

KP<br />

i(<br />

M ) j(<br />

M )<br />

⎞<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎟<br />

⎠<br />

где: функция i(m) показывает номер нейрона, из которого исходит связь m; j(m)<br />

-номер нейрона, в который входит связь m; M – число связей (т.е. число настраиваемых<br />

параметров) в нейросети; e kp – ошибка прогноза для k-го выходного<br />

нейрона и p-го объекта из обучающей выборки; K – число выходных нейронов<br />

(равное числу одновременно прогнозируемых свойств); P – число объектов<br />

32<br />

(33)