4.04.03.53.53.03.0Position Y (m)2.52.01.5Position Y (m)2.52.01.51.01.00.50.500 1.0 2.0 3.0 4.0 5.0 6.0 7.0Position X (m)00 1.0 2.0 3.0 4.0 5.0 6.0 7.0Position X (m)a) Ultrasonic Three Dimensional Tag Systemb) Microphone Array SystemFigure 7: Tracking of A Moving Sound Source with the HeadingNOE AIST [1] P. Aarabi and S. Zaky. Robust sound localization using multi-sourceaudiovisual information fusion. Information Fusion, 2(3):209–223,2001.[2] R. Biswas and S. Thrun. A passive approach to sensor network localization.In IEEE, editor, Proc. of the IEEE/RSJ Intl. Conference onIntelligent Robots and Systems (IROS 2004), pages 1544–1549, 2004.[3] H. K. Dunn and D. W. Farnsworth. Exploration of pressure field aroundthe human head during speech. Journal of Acoustical Society of America,10(1):184–199, 1939.[4] J.L. Flanagan, D.A. Berkley, G.W. Elko, J.E. West, and M.M. Sondhi.Autodirective microphone systes. Acustica, 73(2):58–71, 1991.[5] L.J. Griffiths and C.W. Jim. An alternative approach to linearly constrainedadaptive beamforming. IEEE Transactions on Antennas andPropagation, AP-30(8):27–34, 1982.[6] E. T. Hall. The Hidden Dimension. Anchor books doubleday, 1966.[7] I. Hara, F. Asano, H. Asoh, J. Ogata, N. Ichimura, Y. Kawai, F. Kanehiro,H. Hirukawa, and K. Yamamoo. Robust speech interface basedon audio and video information fusion for humanoid hrp-2. In Proc. ofIEEE/RAS International Conference on Intelligent Robots and Systems(IROS-2004), pages 2404–2410. IEEE, 2004.[8] J. Hershey, H. Ishiguro, and J. R. Movellan. Audio vision: Using audiovisualsynchrony to locate sounds. In Neural Information ProcessingSystems, volume 12, pages 813 – 819. MIT Press, 2000.[9] C. Jutten and J. Herault. Blind separation of sources, part I: An adaptivealgorithm based on neuromimetic architecture. Signal Processing,24(1):1–10, 1991.[10] Y. Kaneda and J. Ohga. Adaptive microphone-array system for noisereduction. IEEE Transactions on Acoustics Speech Signal Processing,ASSP-34(6):1391–1400, 1986.[11] P.C. Meuse and H.F. Silverman. Characterization of talker radiationpattern using a microphone-array. In Proc. of International Conferenceon Acoustics, Speech, and Signal Processing (ICASSP-94), volume II,pages 257–260, 1994.[12] P.M. Morese and K.U. Ingard. Theoretical Acoustics. McGraw-Hill,1968.[13] K. Nakadai, T. Lourens, H. G. Okuno, and H. Kitano. Active auditionfor humanoid. In Proceedings of 17th National Conference on ArtificialIntelligence (AAAI-2000), pages 832–839. AAAI, 2000.[14] K. Nakadai, D. Matsuura, H. G. Okuno, and H. Tsujino. Improvementof recognition of simultaneous speech signals using av integration andscattering theory for humanoid robots. Speech Communication, 44:97–112, 2004.[15] T. Nakatani and H. G. Okuno. Sound ontology for computational auditoryscene analysis. In Proceedings of 15th National Conference onArtificial Intelligence (AAAI-98), pages 1004–1010. AAAI, 1998.[16] Y. Nishida, H. Aizawa, T. Hori, N.H. Hoffman, T. Kanade, andKakikura M. 3D ultrasonic tagging system for observing human activity.In IEEE, editor, Proceedings of the 2003 IEEE/RSJ Intl. Conferenceon Intelligent Robots and Systems (IROS 2003), pages 785–791,2003.[17] H. Saruwatari, S. Kurita, K. Takeda, F. Itakura, T. Nishikawa, andK. Shikano. Blind source separation combining independent componentanalysis and beamforming. EURASIP Journal on Applied SignalProcessing, 2003(11):1135–1146, 2003.[18] H.F. Silverman, W.R. Patterson, and J.L. Flanagan. The huge microphonearray. Technical report, LEMS, Brown University, 1996.[19] Y. Tatekura, H. Saruwatari, and K. Shikano. Sound reproduction systemincluding adaptive compensation of temperature fluctuation effectfor broad-band sound control. IEICE Trans. Fundamentals, E85-A(8):1851–1860, 2002.[20] J.-M. Valin, F. Michaud, B. Hadjou, and J. Rouat. Localization of simultaneousmoving sound sources for mobile robot using a frequencydomainsteered beamformer approach. In IEEE, editor, Proc. IEEEInternational Conference on Robotics and Automation (ICRA 2004),2004.[21] E. Weinstein, K. Steele, A. Agarwal, and J. Glass. Loud: A 1020-nodemodular microphone array and beamformer for intelligent computingspaces. MIT/LCS Technical Memo MIT-LCS-TM-642, 2004.[22] S. Yamamoto, K. Nakadai, H. Tsujino, and H. G. Okuno. Assessmentof general applicability of robot audition system by recognizingthree simultaneous speeches. In IEEE, editor, Proc. of IEEE/RSJ InternationalConference on Intelligent Robots and Systems (IROS-2004),pages 2111–2116, 2004.82

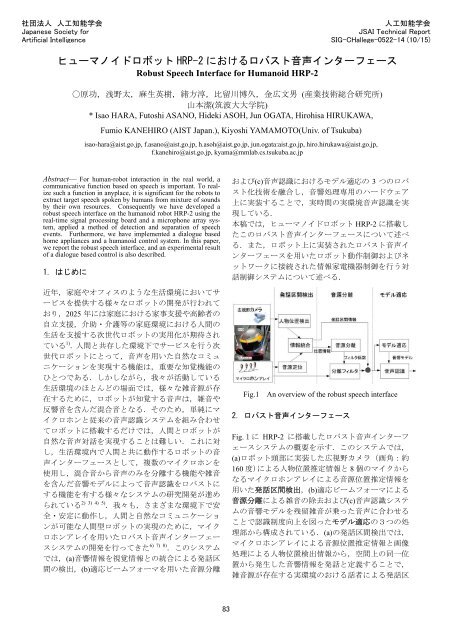

社 団 法 人 人 工 知 能 学 会Japanese Society forArtificial Intelligence人 工 知 能 学 会JSAI Technical ReportSIG-CHallege-0522-14 (10/15)ヒューマノイドロボット HRP-2 におけるロバスト 音 声 インターフェースRobust Speech Interface for Humanoid HRP-2〇 原 功 , 浅 野 太 , 麻 生 英 樹 , 緒 方 淳 , 比 留 川 博 久 , 金 広 文 男 ( 産 業 技 術 総 合 研 究 所 )山 本 潔 ( 筑 波 大 大 学 院 )* Isao HARA, Futoshi ASANO, Hideki ASOH, Jun OGATA, Hirohisa HIRUKAWA,Fumio KANEHIRO (AIST Japan.), Kiyoshi YAMAMOTO(Univ. of Tsukuba)isao-hara@aist.go.jp, f.asano@aist.go.jp, h.asoh@aist.go.jp, jun.ogata:aist.go.jp, hiro.hirukawa@aist.go.jp,f.kanehiro@aist.go.jp, kyama@mmlab.cs.tsukuba.ac.jpAbstract— For human-robot interaction in the real world, acommunicative function based on speech is important. To realizesuch a function in anyplace, it is significant for the robots toextract target speech spoken by humans from mixture of soundsby their own resources. Consequently we have developed arobust speech interface on the humanoid robot HRP-2 using thereal-time signal processing board and a microphone array system,applied a method of detection and separation of speechevents. Furthermore, we have implemented a dialogue basedhome appliances and a humanoid control system. In this paper,we report the robust speech interface, and an experimental resultof a dialogue based control is also described.1. はじめに近 年 , 家 庭 やオフィスのような 生 活 環 境 においてサービスを 提 供 する 様 々なロボットの 開 発 が 行 われており,2025 年 には 家 庭 における 家 事 支 援 や 高 齢 者 の自 立 支 援 , 介 助 ・ 介 護 等 の 家 庭 環 境 における 人 間 の生 活 を 支 援 する 次 世 代 ロボットの 実 用 化 が 期 待 されている 1) . 人 間 と 共 存 した 環 境 下 でサービスを 行 う 次世 代 ロボットにとって, 音 声 を 用 いた 自 然 なコミュニケーションを 実 現 する 機 能 は, 重 要 な 知 覚 機 能 のひとつである.しかしながら, 我 々が 活 動 している生 活 環 境 のほとんどの 場 面 では, 様 々な 雑 音 源 が 存在 するために,ロボットが 知 覚 する 音 声 は, 雑 音 や反 響 音 を 含 んだ 混 合 音 となる.そのため, 単 純 にマイクロホンと 従 来 の 音 声 認 識 システムを 組 み 合 わせてロボットに 搭 載 するだけでは, 人 間 とロボットが自 然 な 音 声 対 話 を 実 現 することは 難 しい.これに 対し, 生 活 環 境 内 で 人 間 と 共 に 動 作 するロボットの 音声 インターフェースとして, 複 数 のマイクロホンを使 用 し, 混 合 音 から 音 声 のみを 分 離 する 機 能 や 雑 音を 含 んだ 音 響 モデルによって 音 声 認 識 をロバストにする 機 能 を 有 する 様 々なシステムの 研 究 開 発 が 進 められている 2) 3) 4) 5) . 我 々も,さまざまな 環 境 下 で 安全 ・ 安 定 に 動 作 し, 人 間 と 自 然 なコミュニケーションが 可 能 な 人 間 型 ロボットの 実 現 のために,マイクロホンアレイを 用 いたロバスト 音 声 インターフェースシステムの 開 発 を 行 ってきた 6) 7) 8) .このシステムでは,(a) 音 響 情 報 を 視 覚 情 報 との 統 合 による 発 話 区間 の 検 出 ,(b) 適 応 ビームフォーマを 用 いた 音 源 分 離および(c) 音 声 認 識 におけるモデル 適 応 の 3 つのロバスト 化 技 術 を 融 合 し, 音 響 処 理 専 用 のハードウェア上 に 実 装 することで, 実 時 間 の 実 環 境 音 声 認 識 を 実現 している.本 稿 では,ヒューマノイドロボット HRP-2 に 搭 載 したこのロバスト 音 声 インターフェースについて 述 べる.また,ロボット 上 に 実 装 されたロバスト 音 声 インターフェースを 用 いたロボット 動 作 制 御 およびネットワークに 接 続 された 情 報 家 電 機 器 制 御 を 行 う 対話 制 御 システムについて 述 べる.Fig.1 An overview of the robust speech interface2. ロバスト 音 声 インターフェースFig.1に HRP-2 に 搭 載 したロバスト 音 声 インターフェースシステムの 概 要 を 示 す.このシステムでは,(a)ロボット 頭 部 に 実 装 した 広 視 野 カメラ( 画 角 : 約160 度 )による 人 物 位 置 推 定 情 報 と 8 個 のマイクからなるマイクロホンアレイによる 音 源 位 置 推 定 情 報 を用 いた 発 話 区 間 検 出 ,(b) 適 応 ビームフォーマによる音 源 分 離 による 雑 音 の 除 去 および(c) 音 声 認 識 システムの 音 響 モデルを 残 留 雑 音 が 乗 った 音 声 に 合 わせることで 認 識 制 度 向 上 を 図 ったモデル 適 応 の3つの 処理 部 から 構 成 されている.(a)の 発 話 区 間 検 出 では,マイクロホンアレイによる 音 源 位 置 推 定 情 報 と 画 像処 理 による 人 物 位 置 検 出 情 報 から, 空 間 上 の 同 一 位置 から 発 生 した 音 響 情 報 を 発 話 と 定 義 することで,雑 音 源 が 存 在 する 実 環 境 のおける 話 者 による 発 話 区83

- Page 4:

SCOT(Smoothed Coherence Transform)P

- Page 8 and 9:

Particle (a)(b)φ12(τ )[14]x ( t )

- Page 10 and 11:

- 8 -

- Page 12 and 13:

1 () 2 SIMO-ICA 3 SIMO-ICA tele

- Page 14:

ICAy FCy FCy SIMO-ICAs 1(t)x 1(t)1(

- Page 17 and 18:

[15] Y. Mori, H. Saruwatari, T. Tak

- Page 19 and 20:

社 団 法 人 人 工 知 能 学

- Page 21 and 22:

• 音 源 位 置マイク配 置

- Page 23 and 24:

Table 1: 6 : SIR (dB)SIR 1 SIR 2 S

- Page 25 and 26:

社 団 法 人 人 工 知 能 学

- Page 27 and 28:

SIMO-ICA SIMO Figure 2(a)SIMO-ICA

- Page 29 and 30:

Binary maskConventional ICAConventi

- Page 31 and 32:

社 団 法 人 人 工 知 能 学

- Page 33 and 34: k lo (l), k c (l), k hi (l) l k c

- Page 35 and 36: 5.75 m4.33 mNoise1.15 mUser 40°2.1

- Page 38 and 39: おける 方 法 論 に 関 し

- Page 40 and 41: Fig.6 は 幼 児 の ABR (Auditory

- Page 42 and 43: ンターフェースはスパイ

- Page 44 and 45: マイクロホン[ 正 面 ][ 左

- Page 46 and 47: s(k)Crosstalkn(k)R S(k)X P(k)X R(k)

- Page 48 and 49: する 隠 れマルコフモデル

- Page 50 and 51: 123ÙÖ ½ ¾º¾ ´º ½µ ´º

- Page 52 and 53: ÌÐ ½ ¿º¾ ÅÎÆÇÂ

- Page 54 and 55: ÁÒØÖÒØÓÒÐ ÓÒÖÒ ÓÒ Á

- Page 56 and 57: 例 えば、 同 一 時 間 差

- Page 58 and 59: いて、θの 絶 対 値 が 大

- Page 60 and 61: Fig.11 にこのシステムの 処

- Page 62 and 63: 5 , 2 EMIEWFig.1 EMIEW EMIEW 6 ,

- Page 64: 0 P th , (14) 4.4 3 4 4 1 , 3

- Page 67 and 68: 社 団 法 人 人 工 知 能 学

- Page 69 and 70: 3.1. 3.2. Fig. 3. The

- Page 71 and 72: 4.1. Fig. 5. The time co

- Page 73 and 74: 社 団 法 人 人 工 知 能 学

- Page 75 and 76: modal (m, ), whispery (w, ), aspir

- Page 77 and 78: Aperiodicity rate (APR)TLR (Time-La

- Page 79 and 80: 社 団 法 人 人 工 知 能 学

- Page 81 and 82: , À, WDS-BF Ñ À℄·

- Page 83: Table 1: Localization Error of A Si

- Page 87 and 88: を 行 い, 閾 値 処 理 を

- Page 89 and 90: 4. 音 声 対 話 制 御 実 験H

- Page 91 and 92: 社 団 法 人 人 工 知 能 学

- Page 93 and 94: 3 HLDAMLLR [3] (Useful Information

- Page 95 and 96: Class 10degClass 20degClass 10degCl

- Page 97 and 98: 社 団 法 人 人 工 知 能 学

- Page 99 and 100: 赤 い 長 方 形 内 ). 以 下

- Page 101 and 102: 5.2 音 場 計 測 結 果(dB SPL)

- Page 103 and 104: 社 団 法 人 人 工 知 能 学

- Page 105 and 106: a) 90 b) 90 MFMc) d) MFMe) 9

- Page 107 and 108: (3) MFT Julius 7.1 Figure 4: SIG2