PDF-Datei - Mathematik und Informatik

PDF-Datei - Mathematik und Informatik

PDF-Datei - Mathematik und Informatik

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

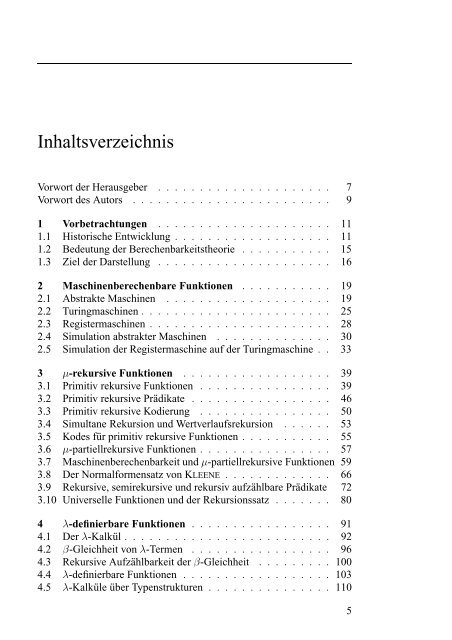

INHALTSVERZEICHNIS5 Unentscheidbare Probleme . . . . . . . . . . . . . . . . . 1175.1 Unlösbarkeitsgrade . . . . . . . . . . . . . . . . . . . . . 1175.2 CHOMSKY Grammatiken . . . . . . . . . . . . . . . . . . . 1205.3 Prädikatenlogik . . . . . . . . . . . . . . . . . . . . . . . 1286 Gr<strong>und</strong>züge der Komplexitätslehre . . . . . . . . . . . . . 1396.1 TIME- <strong>und</strong> SPACE-beschränkte Funktionen . . . . . . . . . 1396.2 Abstrakte Komplexitätsmaße . . . . . . . . . . . . . . . . 1546.3 P- <strong>und</strong> NP- entscheidbare Probleme . . . . . . . . . . . . . 157A Gr<strong>und</strong>lagen der Graphentheorie . . . . . . . . . . . . . 167A.1 Gr<strong>und</strong>begriffe . . . . . . . . . . . . . . . . . . . . . . . . 167A.2 Subgraphen <strong>und</strong> Homomorphismen . . . . . . . . . . . . . 172A.3 Pfadprobleme . . . . . . . . . . . . . . . . . . . . . . . . 174A.4 Markierte <strong>und</strong> gefärbte Graphen . . . . . . . . . . . . . . . 177B Literaturempfehlungen . . . . . . . . . . . . . . . . . . . 181Literaturverzeichnis . . . . . . . . . . . . . . . . . . . . . . . 183Register . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 1876

Vorwort der Herausgeber7

Vorwort des AutorsDer Bitte des Verlages, den vorliegenden Band des Handbuches der<strong>Informatik</strong> zu übernehmen, bin ich anfänglich nur sehr zögerlich gefolgt.Zunächst sah ich die Schwierigkeit, die mathematischen Gr<strong>und</strong>lagen vonden mathematischen Werkzeugen der <strong>Informatik</strong> zu trennen. Eine auchnur annähernd erschöpfende Behandlung der mathematischen Werkzeugedes <strong>Informatik</strong>ers hätte den Rahmen diese Bandes gesprengt <strong>und</strong> hätteauch außerhalb meiner Kompetenz gelegen. Ich mußte mich daher aufdie eigentliche mathematische Gr<strong>und</strong>lage der <strong>Informatik</strong> beschränken,die Theorie der Berechenbarkeit. Diese ist aber hinreichend in einerFülle von Lehrbüchern dargestellt. Wodurch sollte sich die Darstellungin diesem Band von ihnen unterscheiden?Hier kam mir die Intention des Handbuches entgegen, seinen Gegenstandmöglichst beweisfrei darstellen zu wollen. Natürlich ist esunmöglich, eine mathematische Theorie völlig beweisfrei darzustellen,ohne ins belanglose Plaudern zu geraten. Ein solches Buch wäre sinnlos.Was mir vorschwebte, war ein Buch, das einen nur an einem Überblickinteressierten Leser in die Lage versetzt, sich diesen zu verschaffen,indem er allzu detaillierte Ausführungen überliest, aber dennoch geeignetist, als Leitfaden für einen Studierenden zu dienen, der sich genauer mitder Theorie der Berechenbarkeit auseinanderzusetzen hat.Dies sind natürlich im Prinzip unvereinbare Ziele. Als Kompromißhabe ich versucht, die Theorie möglichst zwanglos zu entwickeln<strong>und</strong> dabei das übliche Schema . . . – Definition – Lemma – Beweis –Satz – Beweis – . . . zu vermeiden. Dennoch finden sich in dieser DarstellungDefinitionen <strong>und</strong> Sätze. Dies erscheint mir zur Darstellung einermathematischen Theorie unverzichtbar zu sein. Allerdings habe ichnach Möglichkeit versucht, Definitionen als Präzisierungen anschaulicherSachverhalte zu erarbeiten <strong>und</strong> Sätze als Zusammenfassungen vorhergegangenerÜberlegungen zu formulieren. Das kann natürlich nicht immergelingen. So erfordern viele Partien dieser Darstellung doch eine intensivereMitarbeit des Lesers. Auf der anderen Seite konnten allzu komplexeZusammenhänge oft nur sehr grob skizziert werden oder mußten ganzwegfallen. Für ein gründlicheres Studium sind diese an Hand der zitiertenLehrbücher zu ergänzen.Dennoch hoffe ich, daß dieses Buch dem einen oder anderen Leservon Nutzen sein wird.All denen, die mich bei der Abfassung dieses Textes direkt <strong>und</strong>indirekt unterstützt haben, sage ich hier herzlichen Dank. Dies sind insbesonderedie Mitarbeiter des Institutes für Mathematische Logik derUniversität Münster, die mir oft mit Rat zur Seite standen. Großen Anteil9

haben auch die Münsteraner Studierenden, die in den Einführungsvorlesungenzur theoretischen <strong>Informatik</strong> den hier dargestellten Stoff – inausführlicherer Form – kritisch aufgenommen haben. Ihrer Kritik verdankeich viele Verbesserungen.Mein besonderer Dank gilt Frau Sabine Melles, die die erste (nichtmathematische)Korrektur gelesen hat <strong>und</strong> Herrn stud. math. Martin Wabnik,der die Endfassung nochmals durchgesehen hat. Den Mitarbeiterndes Oldenbourg Verlages danke ich für ihre Unterstützung.Auch ich habe während der Abfassung des Textes etwas gelernt –einige der Geheimnisse der TEX- <strong>und</strong> LAT E X-Systeme. Das Buch wurdevollständig mit LAT E X erzeugt. Allerdings mußten sämtliche .sty<strong>Datei</strong>en (<strong>und</strong> einige LAT E X-Macros) verändert werden, um den Layout-Vorgaben zu genügen. Hier möchte ich mich bei der Systemgruppe unseresFachbereiches bedanken, die mich durch den Dschungel des hiesigen“file system” geleitet hat. Auch meiner Familie, insbesondere meinerFrau, möchte ich für die Geduld danken, die sie immer dann zeigten,wenn ich durch die Tücken des Systems wieder einmal völlig entnervtwar.Münster, im April 1993Wolfram Pohlers10

1. Vorbetrachtungender Traum von der Mechanisierbarkeit der Denkarbeit fort <strong>und</strong> beflügeltdie Forschung. Dank immer leistungsfähiger <strong>und</strong> schneller werdenderRechenanlagen scheint die endgültige Verwirklichung dieses Traumes inimmer greifbarere Nähe zu rücken.Daher erscheint es uns auch für den praktisch arbeitenden <strong>Informatik</strong>erwesentlich zu sein, über die prinzipiellen Grenzen der Mechanisierbarkeitmathematischen Arbeitens informiert zu sein.Es ist sicherlich kein Zufall, daß eine mathematische Theorie der Algorithmen,eben die Berechenbarkeitstheorie, erst in unserem Jahrh<strong>und</strong>ertentwickelt wurde, in dem der Glaube an die Existenz des allumfassendenAlgorithmus ins Wanken geriet. Erst jetzt versuchte man nachzuweisen,daß gewisse Probleme aus prinzipiellen Gründen nicht algorithmischlösbar sein können. Dies ist ein konzeptuell viel schwierigeres Unterfangen,als die Lösbarkeit eines Problems nachzuweisen. Im letzteren Fallhat man einfach einen Algorithmus anzugeben, was im Einzelfall schwierigsein mag, aber keine besondere Theorie der Algorithmen erfordert.Der Unlösbarkeitsbeweis läßt sich hingegen nicht durch Austesten allerAlgorithmen führen. Davon gibt es unendlich viele. Hier wird wirklicheine Theorie der Algorithmen benötigt.Die Entwicklung dieser Theorie ist ein Werk der letzten 70 Jahre. Die Geschichtedieser Entwicklung ist auf Gr<strong>und</strong> des geringen zeitlichen Abstandes daher nur äußerstunzuverlässig darzustellen. Eine Beurteilung der Quellen nach wissenschaftshistorischenGesichtspunkten steht unserer Kenntnis nach noch aus. Daher bitten wir, denfolgenden historischen Abriß mit der nötigen Vorsicht zu betrachten. Insbesonderekann keine Garantie dafür übernommen werden, daß die Prioritäten für die frühen Ergebnissehier richtig eingeordnet werden. Da dies nicht das eigentliche Anliegen diesesBuches ist, wäre die dazu erforderliche Literaturrecherche viel zu aufwendig gewesen.Wir folgen hier einfach der herrschenden Meinung. Eine wesentliche Quelle hierfürwar die von MARTIN DAVIS herausgebene Antologie [DAV64]. Eine exakte Aufhellungder historischen Entwicklung der Berechenbarkeitstheorie ist eine Aufgabe, die einemWissenschaftshistoriker vorbehalten bleiben muß.Als sicher anzusehen ist die enge Verzahnung der Berechenbarkeitstheoriemit der Entwicklung der mathematischen Logik. Im Vordergr<strong>und</strong>stand hier zunächst das Entscheidungsproblem, die Frage, ob sich dieHerleitbarkeit einer logischen Formel in einem Logikkalkül entscheidenläßt. Also wieder das Motiv der Ars Magna. Formalisierte Logikkalkülestanden zur Verfügung seitdem, beginnend mit dem Jahr 1910, BERT-RAND RUSSELLs [ ∗ 1872, †1970] <strong>und</strong> ALFRED N. WHITEHEADs [ ∗ 1861,†1947] Werk Principia Mathematica veröffentlicht wurde. Allerdingswar man sich zu diesem Zeitpunkt der Vollständigkeit dieser Kalkülenoch nicht sicher. Diese wurde erst im Jahre 1930 von KURT GÖDEL[ ∗ 1906, †1978] nachgewiesen. Doch bereits im Jahre 1915 erschien eineSchrift von LEOPOLD LÖWENHEIM [ ∗ 1878, †1957], in der er ein Ent-12

1.1. Historische Entwicklungscheidungsverfahren für ein Fragment der Prädikatenlogik angibt. DieseArbeit konnte 1923 von THORALF SKOLEM [ ∗ 1878, †1963] zu einem Beweisder Entscheidbarkeit eines Fragments der Logik erweitert werden,das wir heute als monadische Prädikatenlogik der ersten Stufe bezeichnen.Weitere positive Lösungen des Entscheidungsproblems wurden vonMOJEZESZ PRESBURGER [ ∗ 1904, †wahrscheinlich 1943 im WarschauerGhetto] (Entscheidbarkeit der Arithmetik mit der Addition als einzigemFunktionssymbol), ALFRED TARSKI [ ∗ 1901, †1983] (Entscheidbarkeitvon Formeln der Theorie reller Zahlen, die nur die Symbole + <strong>und</strong> ≤enthalten) sowie nochmals T. SKOLEM (Entscheidbarkeit der Arithmetikmit der Multiplikation als einzigem Funktionssymbol) erzielt.Der Begriff der Definition durch Rekursion scheint unter <strong>Mathematik</strong>ernder Jahrh<strong>und</strong>ertwende mehr oder minder explizit bekannt gewesenzu sein. DAVID HILBERT [ ∗ 1862, †1943] gibt in seiner Schrift “Über dasUnendliche” bereits einen allgemeinen Rekursionsbegriff an. Im Jahre1931 veröffentlicht K. GÖDEL in seinem Artikel “Über formal unentscheidbareSätze der Principia Mathematica <strong>und</strong> verwandter Systeme”seine berühmten Unvollständigkeitssätze. In dieser Arbeit klassifiziert erdiejenigen Funktionen als rekursiv, die wir heute als primitiv rekursiv bezeichnen(vgl. Abschnitt 3.1). RÓZSA PÉTER [ ∗ 1905, †1977] führt 1934in [PET34] den Terminus der primitiven Rekursion ein <strong>und</strong> untersuchtdie Abschlußeigenschaften der Klasse der im Sinne GÖDELs rekursiven(also im heutigen Sinne primitiv rekursiven) Funktionen gegenüberverschiedenen Formen der Rekursion, wie etwa Wertverlaufsrekursion,mehrfacher Rekursion etc. In ihrer Arbeit [PET35], die im Jahre 1935erscheint, zeigt sie, daß eine von WILHELM ACKERMANN [ ∗ 1896, †1962]bereits im Jahre 1928 angegebene <strong>und</strong> von ihr stark vereinfachte Funktionzwar berechenbar ist, jedoch nicht in der von GÖDEL beschriebenenKlasse liegen kann.In der Zeit von 1933-1934 hält sich GÖDEL im Institute for AdvancedStudies in Princeton, New Jersey auf. In einer Vorlesung im Jahre1934, unter deren Hörern sich ALONZO CHURCH [ ∗ 1903], STEPHEN C.KLEENE [ ∗ 1909] <strong>und</strong> JOHN B. ROSSER [ ∗ 1907, †1989] befinden, – dievon den beiden letztgenannten angefertigte Mitschrift der Vorlesung istin [DAV64] abgedruckt – geht er auf die ACKERMANNsche Funktionein <strong>und</strong> entwickelt den Begriff einer allgemeinrekursiven Funktion, wobeier sich auf Ideen stützt, die ihm, seinen eigenen Angaben nach,von JACQUES HERBRAND [ ∗ 1908, †1931] mündlich mitgeteilt wurden.A. CHURCH veröffentlicht im Jahre 1936 die Arbeit [CHUR36a], in derer seinen λ-Kalkül (vgl. Abschnitt 4.1) entwickelt, <strong>und</strong> zeigt, daß jedeallgemeinrekursive Funktion λ-definierbar ist. Diese Arbeit enthält auchdie These, daß jede berechenbare Funktion allgemeinrekursiv ist; sie13

1. Vorbetrachtungenist heute als CHURCHsche These (vgl. Abschnitt 3.7) bekannt. Er zeigtedarüber hinaus die Existenz eines algorithmisch unlösbaren Problems <strong>und</strong>erweiterte dies in der Note [CHUR36b], die ebenfalls 1936 erschien, zueinem Beweis der Unlösbarkeit des Entscheidungsproblems der Prädikatenlogik.Ebenfalls im Jahre 1936 erscheint KLEENEs Arbeit [KLEE36],in der er den GÖDEL-HERBRANDschen Ansatz analysiert <strong>und</strong> zu einerCharakterisierung rekursiver Funktionen gelangt, indem er die primitivrekursiven Funktionen gegenüber dem Suchoperator abschließt. (DieserAnsatz ähnelt daher dem, der hier im Abschnitt 3.6 präsentiert wird.)Diese Arbeit enthält bereits eine gut entwickelte Theorie. Man findet dasNormalformentheorem, der Begriff einer rekursiv aufzählbaren Mengewird eingeführt <strong>und</strong> KLEENE zeigt, daß die Menge der Indizes rekursiverFunktionen nicht rekursiv aufzählbar sein kann. Eine Abr<strong>und</strong>ung dieserErgebnisse findet man dann in der späteren Arbeit [KLEE43], in der auchder Begriff der partiellen Funktion explizit eingeführt wird.Unabhängig davon publiziert ALAN M. TURING [ ∗ 1912, †1954],ebenfalls im Jahre 1936, in [TUR36] seinen Ansatz zur präzisen Erfassungder Berechenbarkeit. Dort entwickelt er die Turingmaschine <strong>und</strong>kann nachweisen, daß turingberechenbare <strong>und</strong> λ-definierbare Funktionenübereinstimmen. Er zeigt die Unlösbarkeit des Halteproblems <strong>und</strong>überträgt dies auf die Unentscheidbarkeit der Prädikatenlogik. So erhälter unabhängig von CHURCH ebenfalls die Unlösbarkeit des Entscheidungsproblems.EMIL POST [ ∗ 1897, †1954] entwickelt unabhängig von TURING einenpraktisch identischen Ansatz. In Kenntnis der Arbeit CHURCHs veröffentlichter im Jahre 1936 die Arbeit [POST36], in der exakt die abstrakteMaschine beschrieben wird, die wir heute als Turingmaschine bezeichnen.Die Zeit bis zum Jahre 1936 kann demnach als die Periode angesehenwerden, in der der Begriff der intuitiven Berechenbarkeit seinemathematische Form erhalten hat. Die folgenden Jahre bringen die Befestigungder Theorie. So enthält die von KLEENE im Jahre 1943 publizierteArbeit “Recursive Predicates and Quantifiers” eine bereits völlig modernanmutende Darstellung der Berechenbarkeitstheorie. Er führt dortpartiellrekursive Funktionen ein <strong>und</strong> betrachtet bereits relativierte Rekursivität.Eine ähnliche Begriffsbildung findet sich auch in TURINGS Arbeit[TUR39], die 1939 erscheint <strong>und</strong> Turingmaschinen mit Orakeln betrachtet.Im Jahre 1947 zeigt POST, daß das Wortproblem für Halbgruppenunentscheidbar ist.Alle diese Untersuchungen waren sehr mathematisch motiviert –obwohl Forscher wie TURING durchaus auch den Bau von Rechenmaschinenim Sinn hatten. Wesentlichen Niederschlag in der Konstruktion14

1.2. Bedeutung der Berechenbarkeitstheorievon Rechenmaschinen fanden die Ideen der Berechenbarkeitstheorie inder Anregung JOHN V. NEUMANNs [ ∗ 1903, †1957], universelle Maschinenzu bauen. Dies kann als der Durchbruch in der Entwicklung zum modernenComputer angesehen werden. Neuere Entwicklungen der Theorie,wie sie sich beispielsweise in der Komplexitätslehre finden, sind bereitsviel stärker von Motiven geprägt, die aus der rechnergerechten Aufbereitungpraktischer Probleme stammen. Hier beobachtet man ein fruchtbaresWechselspiel zwischen Theorie <strong>und</strong> Praxis, vergleichbar dem, wiees sich zwischen <strong>Mathematik</strong> <strong>und</strong> Physik abspielt. Die Historie dieserEntwicklungen ist jedoch viel zu jung, als daß sie mit hinreichenderZuverlässigkeit hier dargestellt werden könnte.1.2 Bedeutung der BerechenbarkeitstheorieDie ersten wesentlichen Ergebnisse der Berechenbarkeitstheorie warennegativer Art, indem sie zeigten, daß gewisse Probleme, die mangerne mechanisch mit Hilfe von Algorithmen entschieden hätte, sich ausprinzipiellen Gründen so nicht entscheiden lassen. Insbesondere bedeutetedas, daß der Traum von der Ars Magna sich zumindest nicht globalverwirklichen läßt.Dieses Ergebnis darf man aber auf keinen Fall dahingehend interpretieren, daßdamit die Suche nach Algorithmen obsolet geworden wäre. Ganz im Gegenteil. Wirmüssen davon ausgehen, daß die Kollektion der Erkenntnisse, die von denkenden Menschengewonnen wird, eine im Sinne des Abschnitts 3.9 rekursiv aufzählbare Mengeist. Dies trifft zumindest für die in der <strong>Mathematik</strong> beweisbaren Sätze zu <strong>und</strong> läßt sichauf alle solche Erkenntnisse erweitern, die durch Folgern aus entscheidbaren Faktengewonnen werden können. Das bedeutet aber, daß ein Algorithmus existiert, der allediese Erkenntnisse erzeugt. Es gibt also keinen mathematischen Gr<strong>und</strong> dafür, daßnicht alles das, was von Menschen geleistet wird, nicht auch von einer Maschine zuleisten wäre. Allerdings fehlt der Maschine bis heute noch immer die selektive Fähigkeitdes Menschen, aus der Beurteilung von Ergebnissen <strong>und</strong> Zwischenergebnissenuninteressante Resultate zu unterdrücken <strong>und</strong> aussichtslose Wege gar nicht erst weiterzuverfolgen.Diese Situation erinnert etwas an die der frühen Schachprogramme, denenman auf Gr<strong>und</strong> ihrer Unfähigkeit, Stellungen zu beurteilen <strong>und</strong> somit aussichtslose Variantenvon vorneherein auszuschließen, keine wesentliche Steigerung der Spielstärkezugetraut hatte. Heute liegen aber Programme vor, die durchaus chancenreich gegenGroßmeister antreten können. Aus dieser Analogie läßt sich die Hoffnung schöpfen,daß eine ähnliche Entwicklung auch in anderen Bereichen erzielt werden kann. DieEntwicklung <strong>und</strong> Implementierung von Selektionsalgorithmen ist jedoch noch immereine Herausforderung der Zukunft, die hohe Ansprüche an die Kreativität der beteiligtenForscher <strong>und</strong> Entwickler stellen wird.Schon um zu verhindern, daß kostbare Zeit an die Lösung prinzipiellunlösbarer Probleme verschwendet wird, sollten die wesentlichsten15

1. VorbetrachtungenUnlösbarkeitsergebnisse daher auch dem praktisch arbeitenden <strong>Informatik</strong>erbekannt sein.An positiven Resultaten hat die Berechenbarkeitstheorie andererseitstiefe Einsichten in die Natur berechenbarer Funktionen geliefert.Hier ist unter anderem das Normalformentheorem des Abschnitts 3.8 zunennen, mit dessen Hilfe sich universelle Funktionen konstruieren lassen.Dies eröffnet die Möglichkeit der Konstruktion abstrakter universellerMaschinen, deren physikalische Realisierung, wie von V. NEUMANNangeregt, unsere heutigen Rechner sind.Die in der Berechenbarkeitstheorie entwickelten Methoden fandenin sehr weite Bereiche der <strong>Informatik</strong> Eingang. Dies wurde immer stärkerder Fall, je mehr sich die <strong>Informatik</strong> von einer “ad hoc Beschäftigung mitRechenmaschinen” zu einer von allgemeinen Prinzipien geleiteten Ingenieurwissenschaftentwickelte. Beispiele hierfür sind die Entwicklungeffizienter, benutzernaher Sprachen <strong>und</strong> deren Implementierung über abstrakteMaschinen.Die in der Berechenbarkeitstheorie entwickelten Methoden bildennatürlicherweise die Basis der theoretischen <strong>Informatik</strong>.Die äußerst befruchtende Wirkung der Berechenbarkeitstheorie aufdie mathematische Logik sei hier nur am Rande erwähnt.1.3 Ziel der DarstellungDer vorliegende Band soll einen Überblick über die Berechenbarkeitstheoriegeben. Dabei erlaubt es der dieser Darstellung gesteckteRahmen nicht, alle Ergebnisse in allen Details zu erarbeiten. Da die Darstellungeiner mathematischen Theorie ohne alle Begründungen jedochäußerst unbefriedigend bleiben muß, haben wir uns bemüht, die Theoriezumindest entlang ihrer Hauptlinien in groben Zügen zu entwicklen.In der Darstellung folgen wir nicht der historischen Entwicklung,sondern beginnen mit dem Ansatz von POST <strong>und</strong> TURING. Dazu stellenwir in Kapitel 2 zunächst ein abstraktes Maschinenkonzept vor <strong>und</strong>präzisieren den Begriff des Algorithmus als Steuerprogramm für eineabstrakte Basismaschine. Dies führt uns zur Klasse der maschinenberechenbarenpartiellen Funktionen. Turing- <strong>und</strong> registermaschinenberechenbareFunktionen sind Spezialfälle davon. Als wesentliches Konzeptwird die Simulation abstrakter Maschinen entwickelt. Dieses verwendenwir dann, um einzusehen, daß sich alle auf Registermaschinen berechenbarenFunktionen auch auf Turingmaschinen berechnen lassen.In Kapitel 3 verfolgen wir einen mehr mathematisch motiviertenAnsatz. Ausgehend von einfachen <strong>und</strong> sicherlich berechenbaren Gr<strong>und</strong>-16

1.3. Ziel der Darstellungfunktionen erhalten wir mit Hilfe der Gr<strong>und</strong>operationen Komposition <strong>und</strong>primitiver Rekursion die Klasse der primitiv rekursiven Funktionen. Wirstudieren deren wesentliche Eigenschaften <strong>und</strong> gelangen dann über eineGödelisierung dieser Funktionen zur Einsicht, daß diese Klasse nicht alleintuitiv berechenbaren Funktionen erfassen kann. Daher erweitern wirdie Gr<strong>und</strong>operatoren um den unbeschränkten Suchoperator <strong>und</strong> schließendann die Gr<strong>und</strong>funktionen gegenüber diesem erweiterten Operatorenbegriffab. Dies zwingt uns wieder, partielle Funktionen zu betrachten,<strong>und</strong> wir erhalten die Klasse der partiellrekursiven Funktionen. Wirüberzeugen uns dann, daß diese mit der Klasse der maschinenberechenbarenpartiellen Funktionen übereinstimmt. Dieser mathematisch stringenteZugang wird es uns erlauben, die wesentlichen Aussagen der Berechenbarkeitstheorie,wie das Normalformentheorem, das S m n -Theorem, denRekursionssatz u.a., zu entwickeln.In Kapitel 4 stellen wir dann den auf CHURCH zurückgehendenkombinatorischen Zugang vor. Wir entwickeln die Gr<strong>und</strong>begriffe des λ-Kalküls, diskutieren das CHURCH-ROSSER Theorem <strong>und</strong> führen schließlichden Begriff der λ-definierbaren Funktion ein. Auch hier können wirfeststellen, daß dies zu der bereits bekannten Klasse von Funktionenführt. Das Kapitel schließt mit einer knappen Einführung in die Theorieder λ-Kalküle mit Typen ein.In dem folgenden Kapitel 5 untersuchen wir als Anwendungsbeispielezwei Entscheidungsprobleme. Wir fragen erst nach der Lösbarkeitdes Wortproblems für CHOMSKY Sprachen <strong>und</strong> stellen dessen Unlösbarkeitfest. Wir gehen dann kurz auf Sprachen mit lösbarem Wortproblemein. Als zweites Beispiel studieren wir das Entscheidungsproblemder Prädikatenlogik. Wir skizzieren, wie dies auf das Halteproblem fürRegistermaschinen reduziert werden kann <strong>und</strong> folgern daraus dessenUnlösbarkeit.Die Darstellung endet in Kapitel 6 mit einem Abriß der Gr<strong>und</strong>lagender Komplexitätslehre, in der der Versuch gemacht wird, durch KomplexitätsbetrachtungenFunktionen nicht nur auf ihre theoretische, sondernauch auf ihre praktische Berechenbarkeit hin zu untersuchen.In einem Anhang stellen wir dann einige Gr<strong>und</strong>begriffe der Graphentheoriezusammen.17

2. Maschinenberechenbare FunktionenEines der Charakteristika eines Algorithmus besteht offensichtlich darin, Algorithmen <strong>und</strong>Maschinendaß die Rechenvorschrift, die durch ihn gegeben wird, nicht an die Intelligenzdes Rechnenden appellieren darf. Sie muß so gegeben sein, daßsie völlig mechanisch ausführbar ist. Damit eröffnet sich natürlich dieMöglichkeit, auch eine Maschine mit der Rechnung zu betrauen. Dieseswird der erste Weg sein, auf dem wir zu einer mathematisch präzisenDefinition der algorithmisch berechenbaren Funktion gelangen werden.2.1 Abstrakte MaschinenDie Mindestanforderungen an eine Rechenmaschine sind offenbardie folgenden:1. Eine Rechenmaschine benötigt einen Speicher, in dem sie Ergebnissespeichern kann.2. Eine Rechenmaschine muß über einen bestimmten Satz S von Modifikationsinstruktionenverfügen, die es erlauben, den Speicherinhalt zumodifizieren.3. Die Rechenmaschine muß darüber hinaus über einen Satz T von Testbefehlenverfügen, die es ihr erlauben, den Inhalt des Speichers zu überprüfen.4. Die Maschine benötigt Eingabefunktionen, die Daten aus D in , derMenge der Eingabedaten, in den Speicher einlesen <strong>und</strong> Ausgabefunktionen,die Speicherinhalte in Elemente von D out , der Menge der Ausgabedaten,transferien können.Die bislang beschriebenen Dinge stellen die Basisingredienzen für eineRechenmaschine dar, durch die ein Maschinentypus festgelegt wird.Sie charakterisieren eine Basismaschine, die wir formal folgendermaßeneinführen wollen.Definition 1 Eine abstrakte Basismaschine ist ein QuintupelB = (M, S, T , IN, OUT)mit folgenden Eigenschaften:1. M ist eine Menge, sie stellt die Menge aller Speicherinhalte dar.2. S ist eine Menge von Abbildungen S: M −→ M. Wir nennen S dieMenge der Modifikationsinstruktionen der Basismaschine.3. T ist eine Menge von Abbildungen T : M −→ {0, 1}. T ist die Men-AbstrakteBasismaschinen19

2. Maschinenberechenbare Funktionenge der Testinstruktionen. Dabei wollen wir sagen, daß der Test einesSpeicherinhaltes m ∈ M positiv verlaufen ist, wenn T (m) = 1 war,anderenfalls ist er negativ verlaufen.4. IN ist eine Abbildung, die jedem Datum d ∈ D in einen SpeicherzustandIN(d) ∈ M zuordnet.5. OUT ist eine Abbildung, die jedem Speicherzustand m ∈ M ein DatumOUT(d) ∈ D out zuordnet.Steuereinheit einerabstraktenBasismaschineSteuerprogrammefür abstrakteBasismaschinenFlußdiagrammeMit einer Basismaschine allein läßt sich allerdings noch nicht rechnen.Es fehlt noch eine Steuereinheit, die den Rechenvorgang in der Maschinesteuert. Wir wollen hier von der Vorstellung ausgehen, daß dieSteuereinheit die Maschine durch ein Programm steuert. Wir haben alsoden Begriff eines Programmes zu entwickeln. Ein Programm besteht ausAnweisungen. Wir unterscheiden dabei zwei Typen von Anweisungen.Einmal haben wir Modifikationsanweisungen von der Form (k, S, m),wobei k <strong>und</strong> m natürliche Zahlen sind <strong>und</strong> S ∈ S eine Modifikationsinstruktionist. Wir nennen k <strong>und</strong> m die Marken der Anweisung, wobei kdie Kenn- <strong>und</strong> m die Sprungmarke der Anweisung heißt. Zum anderenhaben wir Testanweisungen der Form (k, T, v, m), wobei T ∈ T eine Testinstruktionvon B ist <strong>und</strong> die Marken k, m, v wieder natürliche Zahlensind. Wir nennen k wieder die Kennmarke der Anweisung, während m dieSprung- <strong>und</strong> v die Verzweigungsmarke der Anweisung ist. Ein Programmist nun eine endliche Menge von Anweisungen zusammen mit einer ausgezeichnetenMarke k P , die die Startmarke des Programmes P heißt. Wirwerden daher Progamme oft in der Form P = (k P , A) notieren, wobeik P für die Startmarke <strong>und</strong> A für die endliche Menge der Anweisungensteht. Allerdings wollen wir die Schreibweise sehr liberal handhaben <strong>und</strong>oft einfach a ∈ P schreiben, wenn wir ausdrücken wollen, daß a eineAnweisung des Programmes P ist.Programme werden oft in Form von Flußdiagrammen angegeben.So wird beipielsweise das ProgrammP = (k P , {(k P , S 1 , n 1 ), (n 1 , T, v, m), (m, S 3 , n 2 ), (v, S 2 , n 3 )}) (2.1)durch das in Abbildung 2.1 - 1 gezeigte Flußdiagramm dargestellt. Formalsind Flußdiagramme markierte gerichtete Graphen (vgl. Anhang A). MitAusnahme der Start- <strong>und</strong> Endmarken, die als ausgezeichnete Knotenauftreten, werden die Programmarken durch unmarkierte Kanten, Befehledurch markierte Knoten repräsentiert. Die Abfolge von Kenn- <strong>und</strong>Sprung- bzw. Verzweigungsmarken wird durch die Richtung der Kantenangezeigt. Hier kommt die Eigenschaft von Programmen zum Ausdruck,daß ihre Wirkung bei (korrekter) Umbenennung von Marken nichtverändert wird. Man kann Programme als identisch betrachten, wenn sie20

2.1. Abstrakte MaschinenSTARTS1TJAS 2ENDNEINS3ENDAbb. 2.1 - 1: Beispiel eines Flußdiagrammesdurch die gleichen Flußdiagramme dargestellt werden, d.h. durch geeigneteUmbenennung von Programmarken auseinander hervorgehen. Dieswird sofort klar, wenn man sich von der anschaulichen Vorstellung leitenläßt, daß ein Programm die Steuereinheit (finite control) der Maschine beschreibt.Die Marken markieren dabei die endlich vielen Zustände, derereine Maschine fähig ist. Die Aktion der Maschine erfolgt in Abhängigkeitihres augenblicklichen Zustandes <strong>und</strong> des Speicherinhaltes. Die Startmarkemarkiert den Anfangszustand der Maschine, in dem sie sich nach demEinschalten befindet.Die formale Charakterisierung abstrakter Rechenmaschinen gibt die folgendeDefinition.Definition 2 Eine abstrakte Maschine C ist eine abstrakte Basismaschine Abstrakte MaschinenB zusammen mit einem Programm P für B. Wir notieren dies als C =(B, P ).Bei festgehaltener Basismaschine ist die abstrakte Maschine also durchihre Steuereinheit, d. h. durch ihr Programm bestimmt. Wir werden dahernicht immer zwischen der Maschine <strong>und</strong> dem Programm, das siebestimmt, unterscheiden.Haben wir eine abstrakte Maschine C vorliegen, so wollen wir denRechenverlauf in der Maschine beschreiben. Wesentlich dafür ist die21

2. Maschinenberechenbare FunktionenKonfigurationsraumeiner abstraktenMaschineDie Rechenschrittfunktioneinerabstrakten MaschineRechenschritt- oder ÜbergangsfunktionRS C , die einen Schritt in einemBerechnungsvorgang in C beschreibt. Die Rechenschrittfunktion arbeitetauf dem Konfigurationsraum der Maschine C. Der Konfigurationsraumder Maschine C mit Basismaschine B = (M, S, T , IN, OUT) ist der RaumK(C) := M(C) × M,wobei M(C) die Menge aller Marken des Programmes von C bedeutet<strong>und</strong> damit – intuitiv betrachtet – die Menge aller möglichen Zustände derMaschine beschreibt. Informal läßt sich die Wirkungsweise von RS C sobeschreiben, daß, ausgehend von der Konfiguration (k, z), im Programmnachgesehen wird, ob eine Anweisung mit der Kennmarke k vorhandenist. Ist dies der Fall <strong>und</strong> ist k Kennmarke einer Modifikationsanweisung(k, S, p), so wird der Speicherinhalt zu S(z) modifiziert <strong>und</strong> dieMaschine begibt sich in den Zustand p, d.h. es wird die Konfiguration(p, S(z)) angenommen. Liegt eine Testanweisung (k, T, p, q) vor, so wirdder Speicherinhalt nicht modifiziert, je nach Ergebnis der Testinstruktionwird jedoch der Zustand p oder q angenommen. Verläuft der Test positiv,so begibt sich die Maschine in den Zustand p, fällt er negativ aus, so wirdder durch die Sprungmarke markierte Zustand q angenommen. Formalerhalten wir also:RS C (k, z) :=⎧⎪⎨⎪⎩(p, S(z)), falls (k, S, p) ∈ C,(p, z), falls (k, T, p, q) ∈ C <strong>und</strong> T (z) = 1,(q, z), falls (k, T, p, q) ∈ C <strong>und</strong> T (z) = 0,(k, z), sonst.Die Rechenschrittfunktion ist natürlich nur dann eine Funktion im strengenSinne, wenn die Maschine deterministisch ist, d.h. wenn jede Anweisungim Programm durch ihre Kennmarke eindeutig bestimmt ist.Wir sprechen dann von deterministischen Programmen. Es ist durchaussinnvoll auch nichtdeterministische Maschinen zu betrachten. Wir werdendarauf zurückkommen. Im Augenblick wollen wir uns jedoch auf dieUntersuchung deterministischer Maschinen beschränken.Die Iteration der Rechenschrittfunktion definieren wir durch{RS n (k, z), falls n = 0,C (k, z) :=RS C (RS m C (k, z)), falls n = m + 1.Damit ist RS C n (k, z) die n-fache Anwendung von RS C auf (k, z).Die Abarbeitung eines Programmes erfolgt nun in der Weise, daß dieEingabe zunächst vermöge der Eingabefunktion IN in den Speicher gelesenwird. Dies ergibt die Startkonfiguration (k P , IN(d)), wenn k P dieStartmarke des Programmes P <strong>und</strong> d das Datum war, das eingegebenwurde. Dann wird die Rechenschrittfunktion so lange iteriert, bis eine22

2.1. Abstrakte MaschinenEndkonfiguration erreicht ist. Endkonfigurationen sind Konfigurationen Endkonfiguratitonender Form (e, z), in denen e eine Endmarke des Programmes ist, d.h. eineMarke von P , die selbst nicht wieder Kennmarke einer Anweisung in Pist. Endmarken markieren demnach Zustände der Maschine, von denenaus sie nicht mehr vernünftig weiterarbeiten kann <strong>und</strong> daher tunlichststoppen sollte. Mit E(C) notieren wir die Menge der Endkonfigurationendes Programmes der Maschine C.Wir wollen die Ein- <strong>und</strong> Ausgabefunktionen erst einmal außer acht lassen<strong>und</strong> uns auf die Vorgänge in der Maschine beschränken. Wir betrachtenzunächst die inneren Funktionen der Maschine. Die innere RechenzeitfunktionRZ C ordnet einem Speicherinhalt z ∈ M die Anzahl der Schritte Innerezu, um die die Rechenschrittfunktion iteriert werden muß, bis eine Endkonfigurationvorliegt. DasRechenzeitfunktionheißt:RZ C (z) := min{t| RS C t (k p , z) ∈ E(C)}.Wir bemerken hier, daß RZ C keine Funktion im üblichen Sinne ist. Dazubetrachten wir das Programm(k p , T, k p , k p )mit der Startmarke k p . Offensichtlich ist dies ein wohldefiniertes deterministischesProgramm. Allerdings besitzt es keine Endmarken. Damitkann dessen Rechenschrittfunktion niemals eine Endkonfiguration erreichen.Also ist die Rechenzeitfunktion nicht definiert. Es ist natürlichebenso leicht Programme anzugeben, deren Rechenzeitfunktion für gewisseSpeicherzustände definiert, für andere jedoch <strong>und</strong>efiniert ist. Wirstehen daher vor der Notwendigkeit, partielle Funktionen einzuführen,die nicht unbedingt auf ihrer gesamten Quelle definiert sind.Definition 3 Seien Q, Z Mengen <strong>und</strong> D ⊆ Q. Eine Abbildungf: D −→ Zheißt eine partielle Funktion mit Quelle Q <strong>und</strong> Ziel Z. Wir notieren diesalsf: Q −→ p Z.Die Menge D heißt der Definitionsbereich von f <strong>und</strong> wird üblicherweisemit dom(f) bezeichnet. D.h. dom(f) = {x ∈ Q| (∃y)[f(x) = y]}.Eine partielle Funktion heißt total, wenn dom(f) = Q ist, d. h. wenn ihreQuelle <strong>und</strong> ihr Definitionsbereich übereinstimmen.Oft ist es angenehm, sich partielle Funktionen f: Q −→ p Z als AbbildungenPartielle Funktionen23

2. Maschinenberechenbare Funktionen˜f: Q −→ Z ∪ {∞}vorzustellen, die durch˜f(z) :={f(z), falls z ∈ dom(f),∞, sonst,gegeben sind. Zwei partielle Funktionenf, g: Q −→ p Zsind als gleich anzusehen, wenn ˜f <strong>und</strong> ˜g übereinstimmen. Wir definierendaherf(z) ≃ g(z) :⇐⇒ ˜f(z) = ˜g(z),d.h.f(z) ≃ g(z)Schreiben wirf(x) ≃ u,⇐⇒ (z ∉ dom(f) ∧ z ∉ dom(g))∨ (z ∈ dom(f) ∩ dom(g) ∧ f(z) = g(z)).so bedeutet dies, da u immer definiert ist, daß x ∈ dom(f) ist <strong>und</strong> f(x)den Wert u ergibt.Bei der oben definierten inneren Rechenzeitfunktion RZ C handelt es sichoffenbar um eine partielle Funktion RZ C : M −→ p N, wenn wir mit Ndie Menge der natürlichen Zahlen (einschließlich der 0) bezeichnen.Um den Speicherinhalt z einer Konfiguration (m, z) zurückzuerhalten,bedienen wir uns der Projektionsfunktion π 2 . Allgemein sei die i-te (mengentheoretische)Projektion definiert alsInnereResultatsfunktionπ i : M n −→ Mπ i (m 1 , . . . , m n ) := m i ,wobei M eine beliebige Menge bezeichne <strong>und</strong> 1 ≤ i ≤ n ist.Mit Hilfe der inneren Rechenzeitfunktion <strong>und</strong> der Projektion definierenwir die innere Resultatsfunktion alsRES C (z) :≃ π 2 (RS CRZ C (z) (k P , z)),was so zu lesen ist, daß der Funktionswert RES C (z) nur dann definiertist, wenn auch π 2 (RS CRZ C (z) (k P , z)) definiert ist, <strong>und</strong> dann dessen Wertannimmt.24

2.2. TuringmaschinenDie innere Resultatsfunktion liefert uns den Speicherinhalt nach Beendigungder Rechnung. Wir erhalten schließlich die äußere RechenzeitfunktionRz C <strong>und</strong> die äußere Resultatsfunktion Res C einer Maschine C durchKomposition der inneren Funktionen mit den Ein- <strong>und</strong> Ausgabefunktionen,d.h.Äußere Rechenzeit<strong>und</strong>äußereResultatsfunktionRz C (d) :≃ RZ C (IN(d))<strong>und</strong>Res C (d) :≃ OUT(RES C (IN(d))).Die von einer Basismaschine B partiell berechenbaren Funktionen definierenwir alsP B := {f | f = Res Cfür eine abstrakte Maschine C über B}.Die von einer Basismaschine B berechenbaren Funktionen sind gegebendurchF B := {f ∈ P B | f ist total}.Bevor wir die Theorie der abstrakten Maschinen weiterverfolgen, wollenwir die zwei wichtigsten Beispiele solcher Maschinen vorstellen.2.2 TuringmaschinenDas historisch älteste Beispiel einer abstrakten Maschine ist die vonALAN M. TURING eingeführte Turingmaschine. Die Turingmaschine solldas Rechnen mit Bleistift <strong>und</strong> Papier formalisieren. Anschaulich stellenwir uns die Turingbasismaschine als ein nach beiden Seiten hin unendlichesBand vor, das in einzelne Felder unterteilt ist. Auf dem Band Informalearbeitet ein Schreib-Lese-Kopf, der jeweils ein Feld, das Arbeitsfeld, bearbeitenkann. Auf diesem Feld kann er ein Zeichen z eines Alphabetesdrucken (PRT (z)), das Feld löschen (CLR) <strong>und</strong> testen, ob das Zeichen aufdem Feld mit einem vorgegebenen Zeichen z übereinstimmt (BEQ(z)).Schließlich kann die Maschine noch das Arbeitsfeld um ein Feld nachlinks (LFT ) oder nach rechts verlegen (RHT ).Die Menge der Speicherzustände einer Turingmaschine ist durch dieMenge ihrer Bandinschriften gegeben. Wir haben daher diese Menge genauerzu beschreiben. Zunächst wollen wir vereinbaren, daß immer nurendlich viele Felder des Bandes beschrieben sind. Dies ist eine vernünftigeForderung, wenn wir davon ausgehen, daß im Einlesevorgang nurendlich viele Daten auf das Band geschrieben werden können, <strong>und</strong> zu25Beschreibung einerTuringmaschine

2. Maschinenberechenbare FunktionenWörter über einemAlphabetjedem Zeitpunkt in der Rechnung nur endlich viele Rechenschritte absolviertsein können. Auf dem Band stehen also Zeichen. Um dies zupräzisieren, führen wir den Begriff eines Alphabets <strong>und</strong> der über diesemAlphabet gebildeten Wörter ein.Definition 4 Ein Alphabet ist eine endliche, nicht leere Menge A. DieElemente von A heißen die Zeichen oder manchmal auch die Buchstabendes Alphabets A.Ein Wort über A ist ein Tupel (z 1 , . . . , z n ) ∈ A n .Die Menge aller Wörter über A bezeichnen wir üblicherweise mit⋃A ∗ := A n ,n ∈ Nwobei wir n = 0, d.h. das leere Wort Λ, zulassen wollen. Die Menge dernicht leeren Wörter bezeichnen wir mitA + :=⋃n ∈ N + A n ,wobei N + die Menge der positiven natürlichen Zahlen bedeutet. Üblicherweiseschreiben wir Wörter unter Weglassen der Klammerung alsz 1 . . . z n .Die Länge eines Wortes w ∈ A ∗ ist gegeben durchl(w) := min{n| w ∈ A n }.Die Verkettung zweier Wörter u = z 1 . . . z n <strong>und</strong> v = a 1 . . . a m ist dasWortu ⌢ v := z 1 . . . z n a 1 . . . a m .Das nach beiden Seiten unendliche Band der Turingmaschine läßt sichgut durch die Menge Z der ganzen Zahlen darstellen. Wir stellen unsdabei die Felder des Bandes mit ganzen Zahlen numeriert vor, wobei dasArbeitsfeld die Nummer 0 erhält. Eine Bandinschrift für eine Turingmaschineüber dem Alphabet A ist dann eine Abbildungf: Z −→ A ∪ {B}derart, daß das Urbild f −1 [A] := {x ∈ Z| f(x) ∈ A} der Menge A endlichist. Hier haben wir das Zeichen B (Blank) gewählt, um mitzuteilen,daß ein Feld unbeschrieben (d.h. mit einem “Blank” beschrieben) ist. Damitkönnen wir die Menge der Speicherzustände einer TuringmaschinedurchM = {f | f: Z −→ A ∧ f −1 [A] ist endlich}26

2.2. Turingmaschinenbeschreiben. Informal wollen wir Bandinschriften immer in der FormB ∞ a 1 . . . a m bc 1 . . . c n B ∞beschreiben, wobei das Zeichen B wieder für ein unbeschriebenes Feldsteht <strong>und</strong> a i , b <strong>und</strong> c j Zeichen des Alphabets oder Blanks sind. DasZeichen auf dem Arbeitsfeld ist dabei durch die Unterstreichung hervorgehoben.Bei der Definition von Eingabe- <strong>und</strong> Ausgabefunktionen haben wir natürlichsehr viele Möglichkeiten. Eine einfache Version besteht darin, daßdie Datenmenge durchD := ⋃n∈N(A ∗ ) n ,der Menge der n-Tupel von Wörtern über dem Alphabet A, gegeben ist.Dann haben wir eine einfache EingabefunktionIN(u 1 , . . . , u n ) := B ∞ Bu 1 1 . . . u l(u 1)1 B . . . Bu 1 n . . . u l(u n)n B ∞ ,wenn jedes Wort die Form u i = u 1 i . . . u l(u i)ihat <strong>und</strong> die AusgabefunktionOUT(B ∞ . . . au 1 1 . . . ul(u 1)1 B . . . Bu 1 n . . . ul(u n)n B ∞ ) := (u 1 , . . . , u n ).Interessant sind vor allem die mit Turingmaschinen berechenbaren Funk- Turingbasismaschinenfür dietionen f: N k −→ N l . Zu ihrer Beschreibung benötigt man eine Kodierungnatürlicher Zahlen. Hier kann man bereits mit Turingmaschinen zahlentheoretischerBerechnungüber einem einelementigen Alphabet A = {⋆} auskommen. Für deren FunktionenBasismaschinen läßt sich der Instruktionssatz etwas einfacher schreiben.Statt PRT (⋆) schreiben wir einfach PRT , <strong>und</strong> BEQ steht für BEQ(B),d.h. BEQ nimmt genau dann den Wert 1 an, wenn das Arbeitsfeld leerist. Natürliche Zahlen n kodieren wir durch das Wort ⋆ . . . ⋆. Wir setzen Kodierung⋆ 0 = Λ<strong>und</strong>⋆ n+1 = ⋆ ⌢ ⋆ n} {{ }n-fach<strong>und</strong> erhalten so ⋆ n = ⋆ . . . ⋆. Dann können wir EingabefunktionenIN k : N k −→ M<strong>und</strong> Ausgabefunktionen} {{ }n-fach27natürlicher Zahlenüber einemeinelementigenAlphabet

2. Maschinenberechenbare FunktionenOUT l : M −→ N ldefinieren durch:IN k (n 1 , . . . n k ) := B ∞ B ⋆ n 1B . . . B ⋆ n kB ∞ (2.2)<strong>und</strong>OUT l (B ∞ vz ⋆ n 1B . . . B ⋆ n kB ∞ ) := (n 1 , . . . , n l ). (2.3)TuringberechenbareFunktionenDabei ist zu bemerken, daß wir ohne Einschränkung der Allgemeinheitl ≤ k annehmen können, denn B ∞ kodiert ja beliebig viele Nullen.Ganz offensichtlich hängt die Klasse der auf Turingmaschinen berechenbarenFunktionen wesentlich von der Definition der Ein- <strong>und</strong> Ausgabefunktionenab. Da wir uns in der Entwicklung der Theorie der berechenbarenFunktionen ohne Einschränkung der Allgemeinheit auf Funktionenüber den natürlichen Zahlen beschränken können, werden wir im folgendendie Funktionen von N k nach N l als turingberechenbar ansehen, diesich über der Turingbasismaschine Tur mit dem einelementigen Alphabet{⋆} <strong>und</strong> den in (2.2) bzw. (2.3) definierten Ein- <strong>und</strong> Ausgabefunktionenberechnen lassen. Das ist zur Entwicklung der allgemeinen Theorie ausreichend.Für weitergehende Betrachtungen, insbesondere für Komplexitätsbetrachtungen,kann es notwendig werden, elaboriertere Kodierungennatürlicher Zahlen <strong>und</strong>, damit verb<strong>und</strong>en, auch veränderte Ein- <strong>und</strong>Ausgabefunktionen zu betrachten.Wir definieren die Klasse der turingberechenbaren partiellen FunktionenzuP (k,l)Tur:= {f | f: N k −→ p N l <strong>und</strong> f = Res C },wobei C alle abstrakten Maschinen über der TuringbasismaschineTur (k,l) := (M, {LFT , RHT , PRT , CLR}, {BEQ}, IN k , OUT l )mit dem Alphabet {⋆} durchläuft. Die Klasse der turingberechenbarenFunktionen notieren wir alsF (k,l)Tur:= {f ∈ P (k,l) | f ist total}.Tur2.3 RegistermaschinenEine weitere abstrakte Maschine erhalten wir aus der Abstrahierung desAbaccus. In vereinfachter Form haben viele von uns derartige Rechenbretterbereits in der Kinderzeit kennengelernt. Sie bestehen aus einemHolzrahmen, in dem parallele Drähte gespannt sind. Auf jedem dieser28

2.3. RegistermaschinenDrähte befinden sich eine Anzahl von Kugeln, die sich verschieben lassen.Jeder dieser Drähte stellt eine Speichermöglichkeit, ein Register dar.Durch Verschieben der Kugeln läßt sich der Inhalt eines Registers heraufoderherunterzählen. In Abstraktion dieser Maschine definieren wir die Registermaschinenr-Registerbasismaschine alsRM r := (N r , S, T , IN, OUT) (2.4)mit S := {INC j , DEC j | 0 ≤ j ≤ r} <strong>und</strong> T := {BEQ j | 0 ≤ j ≤ r}.Dabei zählen die Modifikationsinstruktionen INC j das j-te Register umeines herauf, d.h.INC j (z 1 , . . . , z j , . . . , z r ) := (z 1 , . . . , z j + 1, . . . , z r )<strong>und</strong> DEC j das j-te Register um eines herunter, d.h.DEC j (z 1 , . . . , z j , . . . , z r ) := (z 1 , . . . , z j ·−1, . . . , z r ).Hier haben wir die sogenannte arithmetische Differenz a ·−b verwendet,die definiert ist durch{a − b, falls b ≤ a,a ·−b :=0, sonst.Die Testinstruktionen BEQ j testen, ob das j-te Register leer ist (d.h. dieZahl 0 enthält).Mit der Registermaschine berechnen wir ebenfalls Funktionen von N knach N l . Die natürlichen Ein- <strong>und</strong> Ausgabefunktionen sind daher gegebendurch die FunktionenIN k : N k −→ N rIN k (z 1 , . . . , z k ) := (z 1 , . . . , z k , 0, . . . , 0} {{ }<strong>und</strong>OUT l : N r −→ N lOUT l (z 1 , . . . , z r ) := (z 1 , . . . , z l ),(r − k)-fachwobei wir, ohne damit die Allgemeinheit wesentlich einzuschränken,stillschweigend k, l ≤ r vorausgesetzt haben. Wir definieren die Klasseder auf r-Registermaschinen berechenbaren partiellen Funktionen alsP (k,l)r-RM := {f | f: Nk −→ p N l <strong>und</strong> f = Res C },wobei C alle abstrakten Maschinen über der Basisregistermaschine(N r , {INC i , DEC j | 1 ≤ i, j ≤ r}, {BEQ i | 1 ≤ i ≤ r}, IN k , OUT l )durchläuft. Die Klasse der auf r-Registermaschinen berechenbaren Funk-)29

2. Maschinenberechenbare FunktionenAufRegistermaschinenberechenbareFunktionentionen ist dannF (k,l)r-RMMitP RM:= {f ∈ P (k,l)r-RM| f ist total}.= ⋃ {P (k,l) | r ∈ N, 1 ≤ k, l ≤ r}r-RMbezeichnen wir die auf Registermaschinen (bliebiger Registerzahl) berechenbarenpartiellen Funktionen <strong>und</strong> mit F RM die in P RM liegenden totalenFunktionen.Die nun naheliegende Frage ist, in wie weit die bislang definierten Klassenmaschinenberechenbarer Funktionen übereinstimmen. Um dies zuklären, benötigen wir einige Vorbereitungen.2.4 Simulation abstrakter MaschinenHomomorphismenvon BasismaschinenDie übliche Methode, nachzuweisen, daß für zwei Basismaschinen B 1<strong>und</strong> B 2 , die Klasse P B2die Klasse P B1umfaßt, besteht darin, die MaschineB 1 auf der Maschine B 2 zu simulieren. Das Kernstück der Maschinensimulationbesteht in der Definition von Maschinenhomomorphismen.Ein Homomorphismus der BasismaschineB 1 = (M 1 , S 1 , T 1 , IN 1 , OUT 1 )in die BasismaschineB 2 = (M 2 , S 2 , T 2 , IN 2 , OUT 2 )besteht aus einem Tripel Φ = (Φ 1 , Φ 2 , Φ 3 ) von AbbildungenΦ 1 : M 1 −→ M 2Φ 2 : S 1 −→ S 2Φ 3 : T 1 −→ T 2 ,die das in Abbildung 2.4 - 1 gezeigte Diagramm kommutativ machen.Das heißt, daß die folgenden Beziehungen gelten:Φ 1 (IN 1 (d)) = IN 2 (d),Φ 1 (S(z)) = (Φ 2 (S))(Φ 1 (z)),für d ∈ D in , z ∈ M 1 , S ∈ S 1 <strong>und</strong> T ∈ T 1 .OUT 2 (Φ 1 (z)) = OUT 1 (z)T (z) = (Φ 3 (T ))(Φ 1 (z)),(2.5)In Zukunft werden wir die unteren Indizes weglassen <strong>und</strong> einfach Φ(z), Φ(S)<strong>und</strong> Φ(T ) schreiben. Welche Komponente anzuwenden ist, ergibt sich ausdem Zusammenhang.30

2.4. Simulation abstrakter MaschinenIn1M1TSM1Out1DF1{0,1}F1DIn2M2F3( T )F2( S )M2Out2Abb. 2.4 - 1: Diagramm eines MaschinenhomomorphismusSei nun C eine B 1 -Maschine <strong>und</strong>Φ: B 1 −→ B 2ein Homomorphismus der Basismaschinen. Wir beschreiben, wie sich Fortsetzung vonΦ auf die Maschine C, deren Konfigurationsraum K(C) <strong>und</strong> die daraufoperierende Rechenschrittfunktion fortsetzen läßt. Für eine Modifikationsanweisunga = (n, S, m) seiΦ(a) := (n, Φ(S), m)<strong>und</strong> für eine Testanweisung a = (n, T, p, q)Φ(a) := (n, Φ(T ), p, q).Für ein Programm P = (k P , A), wobei k P die Startmarke <strong>und</strong> A dieAnweisungsmenge bedeuten, definieren wirΦ(P ) := (k P , {Φ(a)| a ∈ A}).War C = (B 1 , P ), so setzen wirΦ(C) := (B 2 , Φ(P )).Ist nun (n, z) eine Konfiguration der Maschine C, so definieren wirΦ(n, z) := (n, Φ(z)),d.h.π 2 (Φ(k)) = Φ(π 2 (k)) für k ∈ K(C).Damit haben wir31Homomorphismenvon Basismaschinen

2. Maschinenberechenbare FunktionenRS Φ(C) (Φ(n, z)) = Φ(RS C (n, z)). (2.6)Da die Endmarken von C <strong>und</strong> Φ(C) übereinstimmen, ist (e, z) genau danneine Endkonfiguration von C, wenn Φ(e, z) eine Endkonfiguration vonΦ(C) ist. Die Rechenschrittfunktion von C wird aber schrittweise in dievon Φ(C) übertragen. Damit giltRZ C (z) ≃ RZ Φ(C) (Φ(z)).Somit ergibt sich für die innere ResultatsfunktionΦ(RES C (z))≃ Φ(π 2 (RS CRZ C (z) (k P , z))) ≃ π 2 (Φ(RS CRZ C (z) (k P , z)))≃ π 2 (RS Φ(C)RZ Φ(C) (Φ(z)) (k P , Φ(z))) ≃ RES Φ(C) (Φ(z)),<strong>und</strong> damit für die äußere ResultatsfunktionRes C (d) ≃ OUT 1 (RES C (IN 1 (d))) ≃ OUT 2 (Φ(RES C (IN 1 (d))))≃ OUT 2 (RES Φ(C) (Φ(IN 1 (d)))) ≃ OUT 2 (RES Φ(C) (IN 2 (d)))≃ Res Φ(C) (d).Die äußeren Resultatsfunktionen für C <strong>und</strong> Φ(C) stimmen demnach überein.Wir haben also den folgenden Satz:Satz 5 Gibt es einen Homomorphismus der Basismaschine B 1 in dieBasismaschine B 2 , so ist P B1 ⊆ P B2 <strong>und</strong> F B1 ⊆ F B2 .Satz 5 gibt uns bereits eine Möglichkeit, Klassen von auf unterschiedlichenBasismaschinen berechenbaren Funktionen zu vergleichen. Allerdingsist diese Möglichkeit noch sehr eingeschränkt, verlangt sie doch,daß jeder Instruktion i auf der einen Maschine genau eine InstruktionΦ(i) auf der anderen entspricht. Anschaulich ist es jedoch völlig klar,daß man zur gleichen Berechenbarkeitsklasse gelangen sollte, wenn manjede Instruktion i auf der einen Maschine durch ein Programm auf der anderensimulieren kann. Um dies zu präzisieren, führen wir einige Begriffeein.Ist P ein Programm auf einer BasismaschineB = (M, S, T , IN, OUT),so nennen wir P eine funktionale Prozedur, wenn dom(RES P ) = M ist.Wir nennen P eine relationale Prozedur, wenn RES P die Identität aufM ist <strong>und</strong> P genau zwei verschiedene Endmarken e 0 <strong>und</strong> e 1 besitzt.Wir können uns nun eine Erweiterung der Basismaschine B konstruieren,indem wir für jede funktionale Prozedur P die Resultatsfunktion RES Pals neue Modifikationsinstruktion hinzunehmen <strong>und</strong> zu jeder relationalenProzedur P eine neue Testinstruktion T p vermöge32

T p (z) :=2.5. Simulation der Registermaschine auf der Turingmaschine⎧⎪⎨⎪⎩0, falls RS PRZ C (z) (k p , z) = (e o , z),1, falls RS PRZ C (z) (k p , z) = (e 1 , z)definieren. Diese erweiterte Maschine nennen wir den Abschluß derMaschine B <strong>und</strong> bezeichnen ihn mit Cl(B). Nach ihrer Konstruktion Der Abschlußberechnen B <strong>und</strong> Cl(B) die gleichen Funktionen. Jede auf B berechenbaretotale Funktion wird auf Cl(B) sogar in einem Schritt berechnet. Alsohaben wirP B = P Cl(B) (2.7)<strong>und</strong>F B = F Cl(B) . (2.8)Nun sind wir in der Lage, die Maschinensimulation zu definieren.Definition 6 Eine Simulation einer Basismaschine B 1 auf einer BasismaschineB 2 ist ein HomomorphismusΦ: B 1 −→ Cl(B 2 ).Als eine Folgerung von Satz 5, (2.7) <strong>und</strong> (2.8) erhalten wir dannSatz 7 Existiert eine Simulation der Basismaschine B 1 auf der BasismaschineB 2 , so giltP B1⊆ P B2<strong>und</strong>F B1⊆ F B2.abstrakterBasismaschinenSimulationabstrakterMaschinen2.5 Simulation der Registermaschine auf der TuringmaschineUm einzusehen, daß alle auf Registermaschinen berechenbaren Funktionenauch TURING-berechenbar sind, genügt es nach dem vorherigenAbschnitt, die Registermaschine auf einer Turingmaschine zu simulieren.Wir gehen also von einer r-Registermaschine R aus. Die Menge derSpeicherzustände von R wird durch N r beschrieben. Die Bandinschriftender Turingmaschine wollen wir wieder mit M notieren. Wir definiereneine AbbildungΦ: N r −→ M(z 1 , . . . , z r ) ↦−→ B ∞ B ⋆ z 1 B . . . B ⋆z r B∞ (2.9)33

2. Maschinenberechenbare Funktionen<strong>und</strong> wollen diese zu einem Homomorphismus in den Abschluß der Basisturingmaschinefortsetzen. Dazu definieren wirΦ(INC i )(B ∞ uz⋆ z 1B . . . B⋆ z iBvB ∞ ) := (B ∞ uz⋆ z B . . . B⋆ z i+1 BvB ∞ ),Φ(DEC i )(B ∞ uz⋆ z 1B . . . B⋆ z iBvB ∞ ) := (B ∞ uz⋆ z 1B . . . B⋆ z i ·−1 BvB ∞ )<strong>und</strong>Φ(BEQ i )(B ∞ uz ⋆ z 1B . . . B ⋆ z iBvB ∞ ) ={0, falls zi = 0,1, falls z i = 1.Die in (2.9) definierte Abbildung ist genau die in (2.2) definierte Inputfunktionfür die Basisturingmaschine. Damit folgtIN Tur = Φ ◦ IN RM<strong>und</strong>OUT RM = OUT Tur ◦ Φ,wobei ◦ die Hintereinanderausführung von Funktionen bedeutet, d.h. fürzwei Funktionen f <strong>und</strong> g ist (f ◦ g)(x) := f(g(x)).Unmittelbar aus den Definitionen erhalten wir auchΦ(INC i (z)) = (Φ(INC i ))(Φ(z)), Φ(DEC i (z)) = (Φ(DEC i ))(Φ(z))<strong>und</strong>BEQ i (z) = (Φ(BEQ i ))(Φ(z)).Hilfsprozeduren fürRegistermaschinenAlles, was daher zu einer Simulation der Registermaschine auf der Turingmaschinenoch fehlt, ist der Nachweis, daß Φ(INC j ) <strong>und</strong> Φ(DEC j )funktionale Prozeduren <strong>und</strong> Φ(BEQ j ) relationale Prozeduren auf derTuringmaschine sind.Um dies einzusehen, definieren wir uns zunächst einige Hilfsprozedurenauf der Turingmaschine. Zum einen benötigen wir eine große RechtsverschiebungRHS, die durch das Flußdiagramm in Abbildung 2.5 - 1gegeben ist. Man überzeugt sich leicht, daß RHS das Arbeitsfeld genauum ein Wort nach rechts verschiebt, d.h.RHS(. . . b ⋆ n B . . .) = . . . b ⋆ n B . . .für n ≥ 0. Analog definiert man eine große Linksverschiebung LFS mitder WirkungLFS(. . . B ⋆ n b . . .) = . . . B ⋆ n b . . . .Programme für Φ(INC j ), Φ(DEC j ) <strong>und</strong> Φ(BEQ j ) erhalten wir, wie in34

2.5. Simulation der Registermaschine auf der TuringmaschineSTARTRHTNEINBEQJAENDAbb. 2.5 - 1: Ein Programm für die Rechtsverschiebung RHSden Abbildungen 2.5 - 2, 2.5 - 3 <strong>und</strong> 2.5 - 4 angegeben. Also gilt:START PRT RHS LFTCLR(j-1)-fachRHTENDLFSLFTPRT(j-1)-fachAbb. 2.5 - 2: Programm für Φ(INC j )Man kann nun die Gegenrichtung des Satzes 8 in analoger Weise durcheine Simulation der Turingbasismaschine auf der Registermaschine beweisen.In dieser Übersicht wollen wir jedoch einen anderen Weg einschlagen,der uns gleichzeitig weitere Einsichten in die Natur berechenbarerFunktionen erlaubt. Wir werden versuchen, eine mehr mathematischmotivierte Theorie der Berechenbarkeit zu entwickeln, <strong>und</strong> so zuder Klasse P der µ-partiellrekursiven Funktionen zu gelangen. Dannwerden wir sehen, daß jede turingberechenbare partielle Funktion schon35Satz 8 Jede auf einer r-Registermaschine berechenbare partielle oder Registermaschinen-totale Funktion ist auch auf der Turingmaschine berechenbar.berechenbareFunktionen sindturingberechenbar

2. Maschinenberechenbare FunktionenSTARTLFTCLR(j-1)-fachRHTRHSRHT(j-1)-fachJABEQ LFT LHS ENDCLRNEINLFT(j-1)-fachPRTLHS RHT CLR ENDAbb. 2.5 - 3: Programm für Φ(DEC j )µ-partiellrekursiv ist, <strong>und</strong> sich umgekehrt jede µ-partiellrekursive Funktionenleicht auf einer Registermaschine berechnen läßt.36

2.5. Simulation der Registermaschine auf der TuringmaschineSTARTRHS(j-1)-fachRHT(j-1)-fachBEQJALHSENDJANEIN(j-1)-fachLHSENDNEINAbb. 2.5 - 4: Programm für Φ(BEQ j )37

3. µ-rekursive FunktionenDer Weg zu einer exakten Definition des Begriffes einer berechenbarenFunktion, den wir in diesem Kapitel beschreiten wollen, besteht darin,daß wir von sehr einfachen Funktionen ausgehen, die ganz offensichtlichberechenbar sind. Wir überlegen uns dann Operationen, die berechenbareFunktionen in berechenbare Funktionen überführen <strong>und</strong> schließendie Gr<strong>und</strong>funktionen unter diesen Operationen ab. Es bleibt dann festzustellen,inwieweit wir damit die intuitiv berechenbaren Funktionen erfaßthaben. Insbesondere wird die so erhaltene Klasse von Funktionen mitden maschinenberechenbaren zu vergleichen sein.3.1 Primitiv rekursive FunktionenBei den folgenden Untersuchungen wollen wir uns auf Funktionen beschränken,die Tupel natürlicher Zahlen auf natürliche Zahlen abbilden.Wir werden später einsehen, daß dies keine wesentliche Einschränkungder Allgemeinheit bedeutet.Eine natürliche Zahl ist dadurch charakterisiert, daß sie entweder 0oder der Nachfolger einer anderen natürlichen Zahl ist. Zur Darstellungnatürlicher Zahlen genügt daher ein Symbol für die 0 zusammenmit einem Symbol S für die Nachfolgerfunktion. Wir können dann jedenatürliche Zahl n durch eine Ziffern = (S(. . . S(0) . . .))} {{ }n-fachrepräsentieren. Um die Schreibweise nicht zu verwirrend zu gestalten,werden wir allerdings nicht immer peinlich zwischen natürlichen Zahlen<strong>und</strong> ihrer Zifferndarstellung unterscheiden.Wenn wir offensichtlich berechenbare Funktionen suchen, denken wirsofort an Funktionen wie die konstanten Funktionen, die jedem Tupelvon Argumenten immer eine konstante natürliche Zahl zuordnen oderdie Projektionsfunktionen, die jedes Tupel (x 1 , . . . , x n ) auf eine seinerKomponenten projizieren. Auch die Nachfolgerfunktion ist offensichtlicheine berechenbare Funktion. Natürlich fallen uns daneben noch eineganze Reihe weiterer Funktionen ein, die uns als intuitiv berechenbargeläufig sind. Wir werden jedoch sehen, daß die eben genannten Funktionenbereits ausreichen. Daher treffen wir die folgende Festsetzung:Zifferndarstellungnatürlicher Zahlen39

3. µ-rekursive FunktionenGr<strong>und</strong>funktionenDefinition 9 (Klasse der Gr<strong>und</strong>funktionen)Gr<strong>und</strong>funktionen sind die konstanten Funktionen C n k mitC n k(x 1 , . . . , x n ) := k,die Projektionsfunktionen P n k mitP n k (x 1, . . . , x n ) := x kSubstitutionPrimitive Rekursionfür 1 ≤ k ≤ n <strong>und</strong> die Nachfolgerfunktion S.Eine Operation, die berechenbare Funktionen wieder in berechenbareFunktionen überführt, ist durch die Komposition zweier Funktionen oderdie Substitution von Funktionen gegeben, wie man diese Operation auchnennt, falls mehr als zwei Funktionen beteiligt sind. Sindg: N m −→ N<strong>und</strong>h i : N n −→ Nfür i = 1, . . . , m gegeben, so ist deren Komposition (bzw. die Substitutionvon h 1 , . . . , h m in g) definiert durchSub(g, h 1 , . . . , h m )(⃗x) := g(h 1 (⃗x), . . . , h m (⃗x)), (3.1)wobei ⃗x ein beliebiges n-Tupel natürlicher Zahlen bedeutet.Im Falle von m = 1 werden wir aber anstelle von Sub(g, h) weiterhing ◦ h schreiben.Eine etwas komplexere Operation ist durch die primitive Rekursiongegeben. Hier gehen wir von zwei Funktioneng: N n −→ N<strong>und</strong>h: N n+2 −→ Naus <strong>und</strong> definieren die durch primitive Rekursion aus ihnen hevorgegangeneFunktionRec(g, h): N n+1 −→ NdurchRec(g, h)(z, ⃗x) :={g(⃗x), falls z = 0,h(z 0 , Rec(g, h)(z 0 , ⃗x), ⃗x), falls z = S(z 0 ),wobei ⃗x wieder ein beliebiges n-tupel natürlicher Zahlen bedeutet.(3.2)40

3.1. Primitiv rekursive FunktionenHier bedarf es eines Augenblickes des Nachdenkens, um einzusehen,daß mit berechenbaren g <strong>und</strong> h auch Rec(g, h) berechenbar ist. DerAlgorithmus zur Berechnung von Rec(g, h)(z, x 1 , . . . , x n ) läßt sich folgendermaßenbeschreiben:Definieren wire 0 = g(⃗x)<strong>und</strong>e z+1 := h(z, e z , ⃗x),so lassen sich die Werte e z für z = 0, 1, . . . sukkzessive berechnen, dawir die Funktionen g <strong>und</strong> h als berechenbar vorausgesetzt haben. DurchInduktion nach z läßt sich nun aber leicht einsehen, daßRec(g, h)(z, ⃗x) = e zist. Damit erhalten wir den Wert von Rec(g, h)(z, ⃗x) durch Berechnungvon e 0 , e 1 , . . . , e z .Wir nennen die Operationen Sub <strong>und</strong> Rec die Gr<strong>und</strong>operationen.Gr<strong>und</strong>operationenDefinition 10 Die Klasse PR der primitiv rekursiven Funktionen ist die Primitiv rekursiveFunktionenkleinste Klasse von Funktionen, die die Gr<strong>und</strong>funktionen enthält <strong>und</strong> diegegenüber den Gr<strong>und</strong>operationen abgeschlossen ist.Hier erscheint es uns nötig zu sein, etwas zu dem Unterschied zwischenextensionaler Auffassung <strong>und</strong> intensionaler Auffassung von Funktionenzu bemerken. In der <strong>Mathematik</strong> werden Funktionenf: A −→ Büblicherweise als durch ihre GraphenG f := {(a, f(a))| a ∈ A}beschriebene Mengen aufgefaßt. Da Mengen allein durch ihre Extension,d.h. durch ihre Elemente bestimmt sind, nennen wir zwei Funktionenextensional gleich, wenn ihre Graphen als Mengen übereinstimmen. Wirnotieren diese Gleichheit durchf = g<strong>und</strong> habenf = g ⇐⇒ dom(f) = dom(g) ∧ (∀x ∈ dom(f))[f(x) = g(x)].Bislang haben wir die Gleichheit von Funktionen auch immer so aufgefaßt.Für die primitiv rekursive Funktion41ExtensionaleAuffassung vonFunktionen

3. µ-rekursive FunktionenF :≡ Sub(P 2 1 , P1 1 , P1 1 )gilt dann offenbarF = P 1 1 ,(∗)denn es ist dom(F ) = dom(P 1 1 ) = N <strong>und</strong> nach (3.1) giltF (x) = P 2 1 (P1 1 (x), P1 1 (x)) = P2 1 (x, x) = x = P1 1 (x),IntensionaleAuffassung vonFunktionenobwohl F <strong>und</strong> P 1 1, als Terme betrachtet, verschieden sind. Wir habenschon durch das Zeichen ≡ in (∗) zum Ausdruck bringen wollen, daß Fnicht bloß extensional, sondern tatsächlich als Term gleich Sub(P 2 1 , P1 1 , P1 1 )sein soll. Dieser intensionalen Gleichheit liegt eine andere Auffassungüber das Wesen einer Funktion zugr<strong>und</strong>e. Hier geht man davon aus, daßeine Funktion nicht im mengentheoretischen Sinn als ihr Graph verstandenwerden darf, sondern nur durch ihren Algorithmus gegeben ist. Dader Aufbau des Termes uns den Algorithmus zur Berechnung der dazugehörigenFunktion liefert, läßt sich die intensionale Gleichheit vonFunktionen durch die Gleichheit der repräsentierenden Terme in befriedigenderWeise beschreiben. Wir werden in Zukunft die intensionaleGleichheit durch ≡ notieren, obwohl diese hier nur selten eine Rollespielen wird.Um völlige mathematische Strenge zu wahren, hätten wir eigentlich von Termen fürprimitiv rekursive Funktionen ausgehen müssen, die sich induktiv durch die folgendenKlauseln definieren lassen:Für alle natürlichen Zahlen n <strong>und</strong> k ist C n k ein n-stelliger primitiv rekursiver Funktionsterm.Für alle natürlichen Zahlen n <strong>und</strong> alle k ∈ {1, . . . , n} ist P n k ein n-stelliger primitivrekursiver Funktionsterm.Ist g ein m-stelliger primitiv rekursiver Funktionsterm <strong>und</strong> sind h 1 , . . . , h m n-stelligeprimitiv rekursive Funktionsterme, so ist auch Sub(g, h 1 , . . . , h m ) ein n-stelliger primitivrekursiver Funktionsterm.Ist g ein n-stelliger <strong>und</strong> h ein n + 2-stelliger primitiv rekursiver Funktionsterm, so istRec(g, h) ein n + 1-stelliger primitiv rekursiver Funktionsterm.Ist nun T ein n-stelliger primitiv rekursiver Funktionsterm <strong>und</strong> sind z 1 , . . . , z n Ziffern,so läßt sich durch die folgenden Klauseln die Auswertung Val(T , z 1 , . . . , z n ) definieren:Val(C n k , z 1, . . . , z n ) = kVal(P n k , z 1, . . . , z n ) = z kVal(Sub(g, h 1 , . . . , h m ), z 1 , . . . , z n ) = Val(g, Val(h 1 , z 1 , . . . , z n ), . . . , Val(h m , z 1 , . . . , z n ))Val(Rec(g, h), 0, z 1 , . . . , z n ) = Val(g, z 1 , . . . , z n )Val(Rec(g, h), S(n), z 1 , . . . , z n ) = Val(h, Val(Rec(g, h), n, z 1 , . . . , z n ), z 1 , . . . , z n )Über seine Auswertung können wir somit jeden n-stelligen primitiv rekursiven Funk-42

3.1. Primitiv rekursive Funktionentionsterm als eine n-stellige Funktion auffassen (was wir auch immer tun werden) <strong>und</strong>erhalten, daß eine Funktion genau dann primitiv rekursiv ist, wenn es einen primitivrekursiven Funktionsterm gibt, dem sie extensional gleich ist. Wie wir bereits am obigeneinfachen Beispiel gesehen haben, können verschiedene Funktionsterme durchausdie gleiche Funktion liefern. Später werden wir einsehen, daß es sogar unendlich vieleverschiedene solche Funktionsterme geben muß.Die explizite Angabe des Funktionstermes, der eine primitiv rekursiveFunktion definiert, stellt sich im allgemeinen jedoch als recht umständlichheraus. Wir können uns dies am Beispiel der Addition natürlicher Die AdditionZahlen klarmachen. Die Addition gehorcht bekanntlich den Rekursionsgleichungenx + 0 = x (= P 1 1(x)) (3.3)<strong>und</strong>x + S(z) = S(x + z). (3.4)Ein Funktionsterm, der die Addtion repräsentiert, ist beispielsweise⊕ :≡ Rec(P 1 1 , Sub(S, P3 2 )).Die Tatsache, daß⊕(z, x) = x + zgilt, erhalten wir leicht durch Induktion nach z. Für z = 0 ist⊕(0, x) = P 1 1 (x) = x = x + 0<strong>und</strong> für z = S(z 0 ) ist⊕(z, x) = Sub(S, P 3 2 )(z 0, (x + z 0 ), x) = S(x + z 0 ) = x + z.Damit ist die Addition natürlicher Zahlen als primitiv rekursiv nachgewiesen.Man kann sich jedoch überlegen, daß bereits die Kenntnis derRekursionsgleichungen (3.3) <strong>und</strong> (3.4) zum Nachweis der primitiven Rekursivitätder Addition ausgereicht hätte. Dazu zeigt man durch Induktionnach z etwas allgemeiner, daß jede Funktion f, die den Rekursionsgleichungenf(0, ⃗x) = g(⃗x) (3.5)<strong>und</strong>f(S(z), ⃗x) = h(z, f(z, ⃗x), ⃗x) (3.6)gehorcht, der durch den Term Rec(g, h) repräsentierten Funktion (extensional)gleich ist. Damit ist f insbesondere (extensional) eindeutig43natürlicher Zahlenist primitiv rekursiv

Die Multiplikationnatürlicher Zahlenist primitiv rekursiv a · 0 = 03. µ-rekursive Funktionenbestimmt. Unter der Voraussetzung, daß die Funktionen g <strong>und</strong> h in (3.5)<strong>und</strong> (3.6) primitiv rekursiv sind – <strong>und</strong> somit durch primitiv rekursiveFunktionsterme repräsentiert werden können –, folgt damit also, daßauch f eine primitiv rekursive Funktion ist, – die dann durch den TermRec(g, h) repräsentiert wird.Da in den Rekursionsgleichungen (3.3) <strong>und</strong> (3.4) nur die primitiv rekursivenFunktionen P 1 1 <strong>und</strong> S auftreten, folgt aus ihnen bereits die primitiveRekursivität der Addition.Wir wollen die gleiche Argumentation verwenden, um nachzuweisen,daß auch die Multiplikation eine primitiv rekursive Funktion ist. DieMultiplikation gehorcht offenbar den Rekursionsgleichungen<strong>und</strong>a · (S(z)) = (a · z) + a.ExponentialfunktionSuper-ExponentiationNachdem wir die Addition bereits als primitiv rekursiv nachgewiesen haben,folgt daraus, daß es einen primitiv rekursiven Funktionsterm gebenmuß, der die Multiplikation repräsentiert. In ähnlicher Weise erhalten wirdie primitive Rekursivität der Exponentialfunktion, die den Rekursionsgleichungenexp(a, 0) = 1<strong>und</strong>exp(a, S(z)) = exp(a, z) · agehorcht. Man kann das Verfahren iterieren, indem man eine Super-Exponentialfunktion durchsexp(a, 0) = 1<strong>und</strong>sexp(a, S(z)) = exp(a, sexp(a, z))definiert. Wir erhalten dannsexp(a, n) = exp(a, (exp(a, (. . . exp(a, 0) . . .)))).} {{ }n-fachDies Verfahren läßt sich noch weiter fortsetzen, indem man eine Super-Super-Exponentialfunktion,Super-Super-Super-Exponentialfunktion, u.s.f. definiert. Es ist bereitsdaraus zu sehen, daß die primitiv rekursiven Funktionen Funktionen mit ungeheuerstarkem Wachstum umfassen. Eine Berechnung aller primitiv rekursiven Funktionen44

3.1. Primitiv rekursive Funktionenauf physikalisch realisierbaren Maschinen ist somit prinzipiell unmöglich, da sie allephysikalisch gegebenen Grenzen sprengen würde. Eine physikalische Grenze wäre beiZugr<strong>und</strong>elegung einer Speicherung mittels elektrischer Ladungen durch die im Universumvorhandenen Ladungsträger gesetzt. Das Wachstum primitiv rekursiver Funktionenwürde deren Zahl schnell überschreiten, selbst wenn wir davon ausgehen, daß bis heutenur Bruchteile der im Universum existierenden Elektronenmassen tatsächlich entdecktsind. Da es uns im Augenblick allerdings nur darauf ankommt, den Begriff der berechenbarenFunktion im allgemeinen zu klären, wollen wir hier auf die Möglichkeiteneiner physikalischen Realisation der prinzipiellen Berechenbarkeit noch nicht eingehen.Beispiele weiterer primitiv rekursiver Funktionen, die in unseren Untersuchungeneine Rolle spielen werden, sind:die Fakultätsfunktion a! mit den Rekursionsgleichungen0! = 1Weitere Beispieleprimitiv rekursiverFunktionen<strong>und</strong>(S(z))! = z! · S(z),die Fallunterscheidungsfunktionen sg <strong>und</strong> sg mit den Rekursionsgleichungensg(0) = 0 sg(S(z)) = 1<strong>und</strong>sg(0) = 1 sg(S(z)) = 0,die Vorgängerfunktion Pd mit den RekursionsgleichungenPd(0) = 0 <strong>und</strong> Pd(S(z)) = z,die arithmetische Differenz mit den Rekursionsgleichungena ·−0 = aa ·−S(z) = Pd(a ·−z).Wir wollen noch bemerken, daß endliche Summen <strong>und</strong> endliche Produkteals Funktionen ihrer oberen Grenzen primitiv rekursiv sind. Auch diesfolgt sofort durch Hinschreiben der Rekursionsgleichungen0∑i=0<strong>und</strong>0∏i=0f(i, ⃗x) = f(0, ⃗x)f(i, ⃗x) = f(0, ⃗x)S(z)∑i=oS(z)∏i=of(i, ⃗x) =f(i, ⃗x) =⎛z∑⎝i=0⎛z∏⎝i=0⎞f(i, ⃗x) ⎠ + f(S(z), ⃗x)⎞f(i, ⃗x) ⎠ · f(S(z), ⃗x).45

3. µ-rekursive FunktionenWeitere primitiv rekursive Funktionen werden wir bei Bedarf zur Verfügungstellen.3.2 Primitiv rekursive PrädikatePrädikate <strong>und</strong>RelationenDas EntscheidungsproblemCharakteristischeFunktionPrimitiv rekursivePrädikateNeben der Berechenbarkeit von Funktionen spielt die Entscheidbarkeitvon Prädikaten eine bedeutende Rolle. Dabei werden Prädikate in derRegel extensional, d.h. als Mengen aufgefaßt. Dies ist der Hintergr<strong>und</strong>der folgenden Definition:Definition 11 Unter einem n-stelligen zahlentheoretischen Prädikat Pverstehen wir eine Menge P ⊆ N n .Wir werden Prädikate oft auch als Relationen bezeichnen <strong>und</strong> anstatt(x 1 , . . . , x n ) ∈ P oft P (x 1 , . . . , x n ) schreiben. Es hat sich eingebürgert,diese Ausdrücke völlig synonym zu verwenden.Das Entscheidungsproblem für ein Prädikat P ist dann die Frage, ob eseinen Algorithmus gibt, der⃗x ∈ P ?entscheidet. Die charakteristische Funktion eines Prädikats P ist gegebendurch{1, falls ⃗x ∈ P ,χ P (⃗x) :=0, falls ⃗x ∉ P .Offenbar läßt sich das Entscheidungsproblem für ein Prädikat P sofortauf das Berechnungsproblem für dessen charakteristische Funktion χ Pzurückführen. Daher nennen wir ein Prädikat primitiv rekursiv, wenndessen charakteristische Funktion χ P primitiv rekursiv ist.Für primitiv rekursive Prädikate können wir also das Entscheidungsproblemin primitiv rekursiver Weise lösen.Ist nun P ein Prädikat, so ist dessen Komplement die MengeC(P ) := {x| x ∉ P }.Die charakteristische Funktion von C(P ) ist ganz offensichtlich durchχ C(P ) = sg ◦ χ Pgegeben. Für primitiv rekursives P ist somit auch C(P ) primitiv rekursiv.Ein ähnliches Ergebnis erhalten wir auch für Vereinigungen <strong>und</strong> Durchschnitteprimitiv rekursiver Prädikate. Hier beobachten wir, daßχ P ∩Q (⃗x) = χ P (⃗x) · χ Q (⃗x)46

3.2. Primitiv rekursive Prädikate<strong>und</strong>χ P ∪Q (⃗x) = sg(χ P (⃗x) + χ Q (⃗x))ist. Damit gilt:Die primitiv rekursiven Prädikate sind gegenüber Komplementen, endlichenVereinigungen <strong>und</strong> endlichen Durchschnitten abgeschlossen.Wählen wir die Schreibweise P (⃗x) anstatt ⃗x ∈ P , so haben wir⃗x ∈ C(P ) ⇔ ¬P (⃗x),⃗x ∈ P ∪ Q ⇔ P (⃗x) ∨ Q(⃗x)<strong>und</strong>⃗x ∈ P ∩ Q ⇔ P (⃗x) ∧ Q(⃗x).Abschlußeigenschaftenprimitivrekursiver PrädikateDaher sprechen wir auch davon, daß die primitiv rekursiven Prädikategegenüber den logischen Operationen ¬, ∨ <strong>und</strong> ∧, die oft auch als dieboolesche Operationen (vgl. Abschnitt 6.3) bezeichnet werden, abge- Boolescheschlossen sind.OperationenEin m-stelliges Prädikat Q entsteht aus einem n-stelligen Prädikat Pdurch Substitution mit den Funktionen f 1 , . . . f n , wenn die f i alle m-stellig sind <strong>und</strong>Q = {⃗x ∈ N m | (f 1 (⃗x), . . . , f n (⃗x)) ∈ P } (3.7)ist. Dann giltχ Q = Sub(χ P , f 1 , . . . , f n )<strong>und</strong> wir erhalten somit:Die primitiv rekursiven Prädikate sind abgeschlossen gegenüber Substitutionenmit primitiv rekursiven Funktionen.Das Prädikat Q in (3.7) bezeichnen wir mit Sub(P, f 1 , . . . , f n ).Neben den bisher behandelten Operationen auf Prädikaten spielt auch derbeschränkte Suchoperator eine wichtige Rolle. Wir wollen diesen mit µ bbezeichnen <strong>und</strong> wie folgt definieren:{min{z ≤ y | (⃗x, z) ∈ P }, falls dies existiert,(µ b P )(⃗x, y) :=0, sonst.Der beschränkte Suchoperator (µ b P )(⃗x, y) sucht demnach nach demkleinsten z ≤ y mit P (⃗x, z) <strong>und</strong> bricht die Suche unter Ausgabe desWertes 0 ab, wenn er kein solches finden kann.BeschränkterSuchoperator47

3. µ-rekursive FunktionenEine deutlich anschaulichere, wenn auch weniger exakte Schreibweisefür den beschränkten Suchoperator istµz ≤ y . (⃗x, z) ∈ P,der wir im folgenden oft den Vorzug geben werden.Für ein n + 1-stelliges Prädikat P ist (µ b P ) eine n + 1-stellige Funktion.Die Funktion (µ b P ) gehorcht den Rekursionsgleichungen(µ b P )(⃗x, 0) = 0<strong>und</strong>BeschränkteQuantifikation(µ b P )(⃗x, S(n)) = (µ b P )(⃗x, n)+S(n) · χ P (⃗x, S(n)) · sg((µ b P )(⃗x, n)) · sg(χ P (⃗x, 0)),wie man leicht nachrechnet. Damit folgt:Für ein n-stelliges primitv rekursives Pädikat ist (µ b P ) eine n-stelligeprimitiv rekursive Funktion.Wir wollen diese Tatsache benützen, um nachzuweisen, daß die primitivrekursiven Prädikate auch gegenüber beschränkter Quantifikationabgeschlossen sind. Ein Prädikat Q entsteht aus P durch beschränkte∀-Quantifikation, fallsQ = {(⃗x, n)| (∀y ≤ n)[(⃗x, y) ∈ P ]}<strong>und</strong> durch beschränkte ∃-Quantifikation, fallsQ = {(⃗x, n)| (∃y ≤ n)[(⃗x, y) ∈ P ]}gilt. Die charakteristische Funktion für das durch beschränkte ∃-Quantifikationerhaltene Prädikat, das wir mit ∃ ≤ (P ) bezeichnen wollen, istgegeben durchχ ∃≤ (P )(⃗x, n) = sg(µy ≤ n. (⃗x, y) ∈ P ) + χ P (⃗x, 0).Wegen(∀y ≤ n)[(⃗x, y) ∈ P ] ⇐⇒ ¬(∃y ≤ n)[(⃗x, y) ∈ C(P )]erhalten wir∀ ≤ (P ) = C(∃ ≤ (C(P ))).Da die primitiv rekursiven Prädikate gegenüber Komplementen abgeschlossensind, haben wir zusammenfassend:Die primitiv rekursiven Prädikate sind abgeschlossen gegenüber beschränkterQuantifikation.48

3.2. Primitiv rekursive PrädikatePrädikatprimitiv rekursive Definitionx = y χ = (x, y) = |x − y| := (x−· y) + (y−· x)x < y χ < (x, y) = sg(y−· x)x ≤ yx < y ∨ x = yx/y “x teilt y” (∃z ≤ y)(y = x · z)Prim(x)“x ist Primzahl”x ∈ {n 1 , . . . , n k }“x ist Element einerendlichen Menge”x ≠ 0 ∧ (∀y ≤ x)(¬(y/x) ∨ y = 1 ∨ y = x)x = n 1 ∨ . . . ∨ x = n kAbb. 3.2 - 1: Einige primitiv rekursive PrädikateDie bisher erarbeiteten Abschlußeigenschaften primitiv rekursiver Prädikateerlauben es uns, bereits eine ganze Reihe von Prädikaten als primitivrekursiv zu erkennen. Eine Auswahl findet sich in der Tabelle in Abbildung3.2 - 1.Wir können beschränkte Quantifikationen als Verallgemeinerungen boolescherOperationen betrachten. Schließlich sind die Bedeutungen von(∀y ≤ n)R(⃗x, y) <strong>und</strong> (∃y ≤ n)R(⃗x, y)Erweiterte boolescheOperationendie vonR(⃗x, 0) ∧ R(⃗x, 1) ∧ . . . ∧ R(⃗x, n)beziehungsweiseR(⃗x, 0) ∨ R(⃗x, 1) ∨ . . . ∨ R(⃗x, n).Erhalten wir ein Prädikat Q aus Prädikaten P 1 , . . . , P n durch sukzessiveAnwendung von booleschen Operationen <strong>und</strong> beschränkten Quantifikationen,so sagen wir, daß Q durch erweiterte boolesche Operationen ausP 1 , . . . , P n hervorgegangen ist. Wir werden dies manchmal alsQ = O(P 1 , . . . , P n )notieren. Aus unseren bisherigen Überlegungen folgt, daß es dann eineprimitiv rekursive Funktion g so gibt, daßχ Q (⃗x) = g(χ P1 (⃗x), . . . , χ Pn (⃗x)) (3.8)49

3. µ-rekursive FunktionenDefinition durchFallunterscheidungist.Wir wollen diesen Abschnitt schließen, indem wir auf die Möglichkeithinweisen, primitiv rekursive Funktionen durch Fallunterscheidung nachprimitiv rekursiven Prädikaten zu definieren. Gehen wir also davon aus,daß R 1 , . . . , R n paarweise disjunkte primitiv rekursive Prädikate sind,d.h. für i, j ∈ {1, . . . , n} mit i ≠ j gilt immer R i ∩ R j = ∅. Sind nung 1 , . . . , g n+1 primitiv rekursive Funktionen, so ist die Funktion f, diedefiniert ist durch die Fallunterscheidungf(⃗x) :=⎧⎪⎨⎪⎩g 1 (⃗x),.g n (⃗x),g n+1 (⃗x),falls R 1 (⃗x),falls R n (⃗x),sonst,primitiv rekursiv. Dies folgt einfach daraus, daß∑f(⃗x) = g 1 (⃗x) · χ R1 (⃗x) + . . . + g n (⃗x) · χ Rn (⃗x) + g n+1 (⃗x) · sg( n χ Ri (⃗x))ist.i=03.3 Primitiv rekursive KodierungKodierungsfunktionenKodierung ist das Herzstück der <strong>Informatik</strong>. Unter einer Kodierung verstehenwir im weitesten Sinne die Verschlüsselung von Information zusammenmit der Möglichkeit, diese verschlüsselte Information wiederzu entschlüsseln. Wenn wir davon ausgehen, daß uns die Information inForm endlicher Folgen natürlicher Zahlen vorliegt, dann bedeutet Kodierungdie Fähigkeit, endlichen Folgen natürlicher Zahlen eine natürlicheZahl so zuzuordnen, daß die ursprüngliche Folge aus dieser Zahl wiederrekonstruiert werden kann. Das heißt, daß wir eine Kodierungsfunktion⋃Kod: N n −→ Nn ∈ Nzusammen mit einer DekodierunsfunktionDkod: rng(()Kod) −→⋃n ∈ Nderart definieren können, daßN nDkod(Kod(x 1 , . . . , x n )) = (x 1 , . . . , x n )gilt, wobei wir mit rng(()f) := {f(x)| x ∈ dom(f)} das Bild (range)einer Funktion f bezeichnen. Wir erhalten eine Längenfunktion50

lh: rng(()Kod) −→ Nlh(x) := min{n| Dkod(x) ∈ N n },3.3. Primitiv rekursive Kodierungdie aus dem Kode die Länge der kodierten Folge berechnet.In diesem Abschnitt wollen wir nachweisen, daß es gelingt, Kodierungsfunktionenin primitiv rekursiver Weise zu definieren. Dabei betonen wirallerdings nachdrücklich, daß es hier nicht auf die Effizienz der Kodierungankommt – obwohl dies im praktischen Bereich von eminenter Wichtigkeitsein kann –, sondern es nur um den Nachweis der prinzipiellenMöglichkeit geht, eine Kodierung primitiv rekursiv zu definieren. Dabei Eine primitivwollen wir eine Kodierung primitiv rekursiv nennen, wenn die FunktionenKod, lh, das Prädikat rng(()Kod) <strong>und</strong> die Komponentenfunktionender Dekodierungsfunktion Dkod alle primitiv rekursiv sind.Die Kodierung, die wir hier angeben wollen, beruht auf der eindeutigenPrimzahlzerlegung für natürliche Zahlen. Dazu definieren wir unszunächst eine Funktion Pz , die die Primzahlen aufzählt. Die Rekursionsgleichungenfür diese Funktion sindPz (0) = 2 (3.9)<strong>und</strong>Pz (S(z)) = min{x| Prim(x) ∧ Pz (z) < x}. (3.10)An den Gleichungen (3.9) <strong>und</strong> (3.10) ist allerdings noch nicht zu sehen,daß die Funktion Pz primitiv rekursiv ist. Dies liegt an der unbeschränktenSuche, die mit der Minimumsbildung in (3.10) verb<strong>und</strong>en ist. UmPz primitiv rekursiv definieren zu können, müssen wir diese Suche beschränken.Das gelingt, wenn man bedenkt, daß im Intervall(Pz (n), Pz (n)! + 1] := {x| Pz (n) < x ≤ Pz (n)! + 1}mindestens eine Primzahl liegen muß. Also können wir (3.10) ersetzendurchPz (S(z)) = µx ≤ (Pz (z)! + 1). (Prim(x) ∧ Pz (z) < x). (3.11)Die zunächst naheliegende Idee, eine Kodierung vermöge der Abbildung(x 1 , . . . , x n ) ↦−→ Pz (0) x1 · · · Pz (n − 1) x nzu definieren, stößt auf die Schwierigkeit, daß dann die Dekodierungennicht eindeutig bestimmt sind. So wäre beispielweise der Kode eines Tupels,das nur aus Nullen besteht, immer 1. Die Länge des ursprünglichenTupels kann aus dem Kode somit nicht berechnet werden. Eine Lösungdieses Problems bestünde darin, die Länge mitzukodieren. Wir wollen51rekursiveKodierungsfunktion

3. µ-rekursive Funktionenhier einen anderen Weg gehen, indem wir dafür sorgen, daß der Exponent0 bei der Kodierung nicht auftreten kann. Wir definieren daher〈x 1 , . . . , x n 〉 :={0, falls n = 0,Pz (0) x 1+1 · · · Pz (n − 1) xn+1 , sonst.Hier folgen wir der Schreibweise der Standardliteratur der Rekursionstheorie,in der die primitiv rekursive Kodierungsfunktion mit 〈. . .〉 bezeichnetwird. Zur Definition der Dekodierung haben wir den Exponentender Primzahl Pz (i) in der Primzahlzerlegung einer natürlichen Zahl x zubestimmen. Dieser ist gegeben durchν(i, x) := min{z | ¬(Pz (i) z+1 /x)}.Da der Exponent kleiner oder gleich x zu sein hat, können wir ν vermögeν(i, x) = µz ≤ x. ¬(Pz (i) z+1 /x)als primitiv rekursive Funktion erhalten. Wir definieren dann(x) i := ν(i, x) ·−1<strong>und</strong>lh(x) := µz ≤ x. ¬(Pz (z)/x)<strong>und</strong> erhalten〈(x) 0 , . . . , (x) lh(x)〉 = x. (3.12)·−1Das Bild der Kodierungsfunktion ist dann die Menge aller “Folgennummern”(englisch “sequence numbers”) <strong>und</strong> wird daher üblicherweise mitSeq bezeichnet. Dann giltSeq := rng(()〈. . .〉) = {x| (∀z ≤ x)(¬(Pz (z+1)/x)∨Pz (z)/x)}, (3.13)womit Seq als primitiv rekursive Menge zu erkennen ist. Die Dekodierungerhalten wir durchDkod(x) := ((x) 0 , . . . , (x) lh(x) ·−1 ).KonkatenationDamit haben wir eine primitiv rekursive Kodierung angegeben.Eine wichtige Funktion auf den Kodes ist die Konkatenation von Kodes.Diese ist gegeben durchx ⌢ y := 〈(x) 0 , . . . , (x) lh(x) ·−1 , (y) 0, . . . , (y) lh (y) ·−1〉. (3.14)Aus der in (3.14) gegebenen Definition erhalten wir sofort, daß52