(y) von

(y) von

(y) von

Erfolgreiche ePaper selbst erstellen

Machen Sie aus Ihren PDF Publikationen ein blätterbares Flipbook mit unserer einzigartigen Google optimierten e-Paper Software.

Seminar: Multivariate Verfahren<br />

Leitung: Dr. Thomas Schäfer<br />

Referenten: Wiebke Hoffmann, Claudia Günther<br />

18.05.2010

Regressionsanalyse – was war das nochmal?<br />

<br />

Grundlagen<br />

•Einfaches lineares Regressionsmodell<br />

•Strukturformel<br />

<br />

Multiple lineare Regression<br />

• Globale Gütemaße<br />

• Voraussetzungen<br />

• Methoden für Prädiktorenauswahl<br />

• Dummy-Variablen

Regressionsanalyse

• Analyse <strong>von</strong> Zusammenhängen zwischen Variablen (X,Y)<br />

• Vorhersage der Y-Werte aus X-Werten<br />

• Versuch, die Y-Werte auf die X-Werte „zurückzuführen“<br />

Regressionstypen<br />

linear<br />

nicht-linear<br />

eine UV Lineare Einfachregression Nichtlinear,<br />

Einfachregression<br />

X<br />

Y<br />

mehrere UV Lineare multiple l Regression Nichtlinear, multiple<br />

l<br />

Regression<br />

X 1<br />

X 2<br />

Y

X 1 , X 2 ,… X i<br />

Y<br />

Prädiktor(en)<br />

Regressor(en)<br />

UV<br />

Bsp:<br />

Funktionen <strong>von</strong> Musik<br />

Kriterium<br />

Regressand<br />

AV<br />

Bsp:<br />

Beliebtheitsgrad <strong>von</strong> Musik

Musik 1 – Klavier<br />

Musik 2 - Rock<br />

Musik 3 – Pop<br />

Musik 4 – Club<br />

Musik 5 - Hip Hop

y<br />

Wo<strong>von</strong> ist es abhängig,<br />

ob ich eine bestimmte<br />

Musik mag<br />

(Musikpräferenz)?<br />

x 1 , x 2 … x i<br />

…hilft mir zu entspannen.<br />

…wühlt mich auf.<br />

…regt mich zum Tanzen oder<br />

zur Bewegung an.<br />

…ist Gesprächsthema<br />

zwischen mir und Freunden/<br />

Bekannten<br />

N = 22<br />

…hilft mir beim Nachdenken

Analyse des stochastischen Zusammenhangs<br />

zwischen einer Zielgröße Y und mehreren<br />

Einflussgrößen X i bei verbundenen Stichproben<br />

(Variabilität <strong>von</strong> Y durch die Variabilitäten der X i erklären)<br />

Welchen stochastischen Zusammenhang gibt es zwischen<br />

der Musikpräferenz (Y) und verschiedenen Funktionen<br />

<strong>von</strong> Musik (X i )?<br />

Vorhersage der Werte einer Variable (Kriterium = Y)<br />

bei Kenntnis der Werte der anderen Variable<br />

(Prädiktor = X)<br />

Durch welche Funktionen <strong>von</strong> Musik kann man am besten<br />

die Musikpräferenz vorhersagen?

1. Zusammenhänge aufzeigen<br />

• Welcher Zusammenhang besteht zwischen einer<br />

Zielgröße (abhängig) und möglichen Einflussgrößen<br />

• Beispiel: Welche Faktoren beeinflussen die<br />

Bewertung der Pflege durch Bewohner in der<br />

stationären Altenpflege<br />

2. Einflussgrößen quantifizieren<br />

• Wie groß ist der Einfluss einer bestimmten Variablen<br />

auf die Zielgröße?<br />

• Beispiel: Wie groß ist der Einfluss des<br />

Zigarettenkonsum <strong>von</strong> Schwangeren auf die<br />

Fehlgeburtenrate?

Ursachenanalysen:<br />

Wie stark ist der Einfluss <strong>von</strong> X auf Y?<br />

Wirkungsanalysen:<br />

ik Wie verändert sich Y bei Veränderung <strong>von</strong> X?<br />

Zeitreihenanalysen:<br />

Wie verändert sich Y im Zeitverlauf? Prognose!

Regressionsanalyse<br />

•Einfaches lineares Regressionsmodell<br />

•Strukturformel<br />

•Regressionskoeffizienten g<br />

b i<br />

•Regressionskonstante b 0<br />

•Kriterium der kleinsten Quadrate

Grundidee: Vorhersage einer Ausprägung<br />

einer abhängigen Variable durch<br />

eine andere (unabhängige)<br />

Variable!<br />

Aus einem Datensatz entwickelt man eine<br />

Vorhersage-Gleichung, h die in diesen<br />

Datensatz die bestmögliche Vorhersage<br />

treffen würde<br />

Ähnlichkeit zur Korrelation<br />

Keine ‚echte‘ Kausalität!

Prinzip: Es wird eine Gerade ermittelt,<br />

die den Zusammenhang zwischen x und y<br />

beschreibt.<br />

y<br />

x

y<br />

Wo<strong>von</strong> ist es abhängig,<br />

ob ich eine bestimmte<br />

Musik mag<br />

(Musikpräferenz)?<br />

x 1 , x 2 … x i<br />

…hilft mir zu entspannen.<br />

…wühlt mich auf.<br />

…regt mich zum Tanzen oder<br />

zur Bewegung an.<br />

…ist Gesprächsthema<br />

zwischen mir und Freunden/<br />

Bekannten<br />

N = 22<br />

…hilft mir beim Nachdenken

vorhergesagter y-Wert<br />

der Person i<br />

X-Wert der Person i<br />

yˆ<br />

i<br />

= b0<br />

+<br />

b<br />

i<br />

⋅<br />

x<br />

i<br />

additive Konstante<br />

(y-Achsen-Abschnitt),<br />

b 0 =a<br />

Regressionskoeffizient<br />

(Steigung)

= „ß-Gewichte“ ß der einzelnen Pädikt Prädiktorvariablen i (auch<br />

Partialregressionskoeffizienten)<br />

relativer Einfluss einer Prädiktorvariablen auf das<br />

Kriterium<br />

Das größte ß symbolisiert den größten Einfluss<br />

ß kann zwischen – 1 und 1 schwanken<br />

Extremere Betas Probleme mit dem Modell<br />

Interpretation: ändert sich x um eine<br />

Standartabweichung, dann ändert sich y<br />

um ß<br />

Standartabweichungen<br />

b i =<br />

r<br />

xy<br />

s<br />

s<br />

y<br />

x

= Schnittpunkt mit der y-Achse<br />

Wenn man über eine Person gar nichts weiß und ein Kriterium<br />

(y) schätzen soll, dann ist der Mittelwert dieses Kriteriums (y)<br />

<strong>von</strong> einer Vielzahl bekannter Personen die beste Schätzung.<br />

b<br />

0<br />

=<br />

y<br />

−bx<br />

i

y<br />

ˆ<br />

i<br />

= b0<br />

+<br />

b<br />

i<br />

⋅<br />

x<br />

i<br />

Die Parameter b 0 und b i werden aus den Merkmalsdaten x<br />

und y nach der Methode der kleinsten Quadrate (auch<br />

Kleinste-Quadrate-Schätzung oder kurz KQ-Schätzung<br />

genannt) berechnet (geschätzt).

Für einen Datensatz (eine Punktewolke) werden<br />

b 0 und b i so gewählt, dass der quadrierte<br />

Vorhersagefehler über alle Probanden minimal<br />

ist:<br />

N<br />

y −<br />

yˆ<br />

( ) min<br />

∑<br />

2<br />

1 =<br />

i =1 i i<br />

Für die Ermittlung der Regressionsgleichung<br />

wird id die Differenz der tatsächlichen tählih <strong>von</strong> den<br />

vorhergesagten y-Werten also quadriert. Das<br />

hat 2 Vorteile…<br />

1. Abweichungswerte sind immer positiv.<br />

2. Große Abweichungen werden stärker berücksichtigt als<br />

kleine Abweichungen.<br />

yˆ<br />

= b<br />

i<br />

0<br />

+<br />

b<br />

i<br />

⋅<br />

x<br />

i

y-Wert der Person i<br />

Regressionskoeffizient (Steigung)<br />

y = b0 +<br />

b<br />

i<br />

⋅<br />

x<br />

+<br />

e V h g<br />

i i<br />

= 0 Vorhersagefehler<br />

additive Konstante<br />

(y-Achsen-Abschnitt)<br />

X-Wert der Person i<br />

…entspricht dem ALM.

Analysieren Regression Linear…

Festlegen <strong>von</strong> x (AV) und y (UV)<br />

AV – Präferenz<br />

UV - nachdenken

Modelle: Aufgenommene und entfernte Variablen +<br />

Methode (Einschluss)<br />

Varianzaufklärung:<br />

Globale Gütemaße:<br />

R 2 *100% Varianz ergibt den<br />

Wie gut gibt die Regressionsfunktion, die<br />

prozentualen Anteil der<br />

beobachteten Daten wieder ?<br />

erklärten Varianz an der<br />

Gesamtvarianz. Im Beispiel<br />

also 42,6%.<br />

KORRIGIERTER DETERMINATIONSKOEFFIZIENT:<br />

‐je mehr Prädiktoren eingehen, umso stärker muss R 2 nach<br />

unten korrigiert werden

t-Test zur Überprüfung der Signifikanz<br />

der Koeffizienten (getestet wird die H 0 ,<br />

dass der Koeffizient in der Population<br />

Null ist, dass also der Prädiktor<br />

unbedeutend ist)<br />

unstandardisierte<br />

Werte für b 0 und b i<br />

y<br />

ˆ<br />

i<br />

= b0<br />

+<br />

b<br />

i<br />

⋅<br />

x<br />

y = 4,681 + 0,458*x<br />

i<br />

standardisierter<br />

Wert für b i<br />

z B wenn Klaviermusik in höchstem Maße (= 10) beim Nachdenken<br />

z.B. wenn Klaviermusik in höchstem Maße (= 10) beim Nachdenken<br />

hilft, ist die Vorhersage für die Musikpräferenz 9,2<br />

(9,261 = 4,681+0,458*10).

Regressionsanalyse<br />

(1) Globale Gütemaße<br />

(2) Voraussetzungen<br />

(3) SPSS – Welche Methode wählen wir?

Hier gibt es im Gegensatz zur einfachen<br />

linearen Regression mehrere Prädiktoren.<br />

ˆ 0 2<br />

i i<br />

y i = b 0<br />

+<br />

b<br />

1<br />

x<br />

1<br />

+<br />

b<br />

2<br />

x 2<br />

+ ...<br />

+<br />

b<br />

x

Analysieren Regression Linear…

Wie präzise sagt die Regressions-<br />

gleichung die Werte der<br />

Kriteriumsvariablen vorher?<br />

Regressionsanalyse<br />

a) Multipler Korrelationskoeffizient R<br />

b) Multipler Determinationskoeffizient R<br />

2<br />

c) Standardschätzfehler s e<br />

d) F-Statistik

… entspricht der Korrelation zwischen vorhergesagten und<br />

tatsächlichen y-Werten.<br />

… ist ein Maß für den Zusammenhang des Kriteriums mit allen<br />

berücksichtigten Prädiktoren.<br />

…sagt aus, „wie gut“ die Vorhersage ist.

Kann unser Regressionsmodell überhaupt<br />

signifikant Varianz in der AV aufklären?<br />

Gesamte<br />

Varianz <strong>von</strong><br />

y<br />

unerklärte<br />

Varianz =<br />

Fehlervarianz =<br />

Residuenvarianz<br />

y-^y<br />

erklärte Varianz<br />

= Varianz <strong>von</strong> ^y

Wieviel Varianz wird aufgeklärt?<br />

R 2 gibt die Gesamtvarianzaufklärung wieder.<br />

R 2 = 0,815 =<br />

67,907<br />

(erklärte Varianz)<br />

________<br />

83,318<br />

(Gesamtvarianz)

(auch Bestimmtheitsmaß th it genannt)<br />

… gibt an, welcher Anteil der Varianz des Kriteriums durch alle<br />

Prädiktoren aufgeklärt werden kann bzw. wie viel Prozent<br />

Streuung in der abhängigen Variable sich auf die unabhängige(n)<br />

Variable(n) zurückführen lassen.<br />

… wird in der Regel geringer ausfallen, als die Summe der<br />

einzelnen Determinationskoeffizienten, weil die Prädiktoren<br />

zumeist redundante Informationen über das Kriterium enthalten.<br />

K<br />

∑<br />

( yˆ<br />

k=<br />

1<br />

R²<br />

=<br />

K<br />

( y<br />

∑<br />

k= 1<br />

k<br />

− y)²<br />

− y)²<br />

yk y<br />

=<br />

erklärte Streung<br />

Gesamtstreuung

Achtung!<br />

Man kann R² künstlich durch die Zahl der Prädiktoren<br />

erhöhen, da R² nie kleiner werden kann, wenn die Zahl der<br />

Prädiktoren steigt.<br />

Je mehr Prädiktoren, desto mehr wird R² „überschätzt“!<br />

korrigiertes R²

Warum wird R-Quadrat korrigiert?<br />

Je mehr UV in die Berechnung eingehen, desto eher wird ihr Einfluss überschätzt.<br />

• Je mehr Prädiktoren man benutzt, desto wichtiger ist es das korrigierte R-Quadrat zu<br />

benutzen und desto stärker weicht dieses <strong>von</strong> R-Quadrat ab.<br />

• … korrigiert auch um die Größe der Stichprobe (N), wobei gilt: Je größer die<br />

Stichprobe, desto eher entspricht das korrigierte dem originalen R-Quadrat.<br />

Wie?<br />

indem Bestimmtheitsmaß th it um eine Korrekturgröße vermindert wird<br />

Fazit:<br />

Das korrigierte R-Quadrat wird besonders bei der Verwendung vieler UV und/ oder<br />

kleiner Stichproben benutzt.

… ist die Standardabweichung d der Residuen.<br />

Je geringer der Fehler, desto genauer die Vorhersage.<br />

… ist ein Maß dafür, wie stark die wahren Kriteriumswerte (y-<br />

Werte) <strong>von</strong> den vorhergesagten Werten abweichen.<br />

… gibt die Streuung der y-Werte um die Regressionsgerade an:<br />

s<br />

n<br />

∑(<br />

y −<br />

ˆ<br />

)²<br />

i<br />

y i<br />

i=<br />

1<br />

2<br />

y. x<br />

=<br />

= sy<br />

⋅ 1−<br />

rxy<br />

n

… prüft jeden einzelnen Prädiktor auf statistische i Signifikanz. ifik<br />

Im vorliegenden Fall können „nachdenken“ und „aufstehen“ auf<br />

dem 5 %-Signifikanzniveau abgesichert werden.

Besitzt das geschätzte Modell auch über die Stichprobe hinaus<br />

für die Grundgesamtheit Gültigkeit?<br />

… testet, ob alle im Schätzmodell enthaltenen UV gemeinsam keinen<br />

Einfluss auf die AV ausüben.<br />

Der F-Wert ist mit einem p-Wert <strong>von</strong> < 0,05 statistisch<br />

signifikant.<br />

Bei Werten < 0,05 erfolgt Ablehnung der H 0 , d.h. die UV üben<br />

einen Einfluss auf die AV aus.<br />

Das vorliegende Modell kann also gegen den Zufall abgesichert<br />

werden.

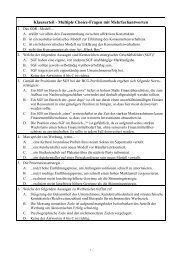

Regressionsanalyse

keine Ausreißer ( Boxplot)<br />

<br />

Normalverteilung der Variablen ( Histogramm)<br />

<br />

Linearität<br />

<br />

Homoskedastizität:<br />

Streuung der Residuen konstant<br />

<br />

Normalverteilung der Residuen<br />

<br />

keine Autokorrelation der Residuen:<br />

statistische Unabhängigkeit der Residuen <strong>von</strong>einander<br />

<br />

keine Multikollinearität:<br />

Unabhängigkeit der unabhängigen Variablen <strong>von</strong>einander

Diagramme<br />

Veraltete Dialogfelder<br />

Streu-/Punkt-Diagramm<br />

Matrix-Streudiagramm

AV und UV in<br />

„Matrixvariablen“ ziehen<br />

(zur Übersichtlichkeit haben<br />

wir nur die ersten 3 UV zur<br />

Demonstration benutzt)<br />

„OK“

Doppelklick auf Diagramm<br />

Diagramm-Editor<br />

Elemente<br />

Anpassungslinie bei<br />

Gesamtwert<br />

Anpassungsmethode:<br />

Lo(w)ess<br />

Glättungsfaktor wählen<br />

(Wieviel % der Nachbarpunkte<br />

sollen in Berechnung<br />

einbezogen werden?)

= Varianzhomogenität (konstante Streuung) der<br />

Residuen/Fehler<br />

Es sollte im Streudiagramm kein Muster erkennbar sein.<br />

Y: ZRESID<br />

X: ZPRED

Hohe Werte der X-Achse<br />

können weniger gut<br />

vorhergesagt werden als<br />

niedrige Werte.<br />

Niedrige Werte der X-<br />

Achse können weniger gut<br />

vorhergesagt werden als<br />

hohe Werte.

Y – ZRESID<br />

X - ZPRED<br />

Beide Diagramme überprüfen an den Residuen, ob Normalverteilung<br />

vorliegt.

Das Histogramm zeigt nur leichte<br />

Abweichungen <strong>von</strong> der<br />

Normalverteilung.<br />

Im P-P-Diagramm werden die<br />

beobachteten gegen g die erwarteten<br />

standardisierten Residuen geplottet.<br />

Bei Normalverteilung müssten die<br />

Werte auf der eingezeichneten<br />

Diagonalen liegen. Dies ist<br />

annähernd der Fall.<br />

Abweichungen <strong>von</strong> der<br />

Normalverteilung nicht sehr<br />

schwerwiegend!

= Fehler sind nicht wie im Modell gefordert unabhängig,<br />

sondern weisen eine spezifische<br />

Form der Abhängigkeit auf<br />

Wo tritt sie auf?<br />

häufig bei zeitlich erhobenen Daten zwischen den<br />

aufeinanderfolgenden f d Beobachtungen<br />

Zeit als Regressor<br />

Test auf das Vorhandensein <strong>von</strong> Autokorrelation:<br />

Durbin-Watson-Test<br />

kann Werte zwischen 0 und 4 annehmen.<br />

e • DW bei 2 zentriert Annahme der H 0 : Die Fehler sind nicht<br />

autokorreliert.<br />

• DW in der Nähe <strong>von</strong> 0 oder 4 Verwerfen der H 0 <br />

Autokorrelation besteht

keine Autokorrelation, da Wert nahe 2

Visualisierung i via Streudiagramm<br />

bei Unabhängigkeit und Normalverteilung: kreisförmig<br />

bei positiver Abhängigkeit: ansteigend gestreckt

… bedeutet, dass die Prädiktoren miteinander korreliert sind.<br />

orthogonale (unkorrelierte) vs.<br />

korrelierte UV<br />

x y 2 x x 1 2<br />

x 1<br />

y

… hat einen großen Einfluss auf den Standardfehler , der dann unter<br />

Umständen sehr anwächst. Die Lösungen werden sehr instabil.<br />

Inwieweit lassen sich lineare Abhängigkeiten unter den<br />

Prädiktoren tolerieren?<br />

<br />

Der Toleranzwert ist daher für die Kollinearitätsdiagnose wichtig:<br />

(1 - R i2 ), d.h. 1 - der multiplen Korrelation des jeweiligen Prädiktors mit den<br />

anderen Prädiktoren.<br />

geringe Toleranz lineare Abhängigkeiten mit anderen Prädiktoren<br />

<br />

VIF (variance inflation factor) baut auf TOLERANCE auf.<br />

VIF = 1 Unabhängigkeit<br />

Er steigt mit wachsender linearer Abhängigkeit.<br />

VIF nahe bei 1 nur geringe Anzeichen auf Kollinearität<br />

„Daumenregel“:<br />

Toleranzwert sollte nicht unter 0,25 sein<br />

VIF-Wert sollte nicht über 5,0 gehen.

einziger<br />

leicht<br />

kritischer<br />

Wert lt.<br />

Daumenregel

… tritt auf, wenn der multiple l Determinationskoeffizient i i größer<br />

als die Summe der einzelnen Determinationskoeffizienten ist.<br />

<br />

ein Prädiktor = ein Suppressor, wenn er zur Vorhersage des<br />

Kriteriums beiträgt, da er unerwünschte (= nicht mit Kriterium<br />

korrelierende) Einflüsse eines anderen Prädiktors unterdrückt<br />

(d.h. Suppressor korreliert mit einem der Prädiktoren aber nicht<br />

oder nur wenig mit Kriterium) und somit dessen Vorhersagekraft<br />

bzgl. des Kriteriums erhöht.

Regressionsanalyse in SPSS<br />

a) Einschluss<br />

a) Einschluss<br />

b) schrittweise

Alle angegebenen Variablen werden für die Vorhersage<br />

benutzt.<br />

WANN?<br />

falls man genau weiß, welche Variablen in der<br />

Regressionsgleichung aufgenommen werden müssen<br />

wenn man anhand der Beta-Koeffizienten den relativen<br />

Beitrag aller Variablen zur Regression vergleichen will

Lediglich „nachdenken“ und „aufstehen“ liefern signifikante Beiträge zur<br />

Varianzaufklärung an dem Kriterium, i dennoch müssen auf der Basis dieser<br />

Modellberechnung alle Prädiktoren in die Gleichung mit aufgenommen<br />

werden.

WANN?<br />

wenn <strong>von</strong> vorneherein nur Variablen in die Regressionsgleichung<br />

aufgenommen werden sollen, die einen signifikanten Beitrag zur<br />

Vorhersage des Kriteriums leisten<br />

VORTEILE<br />

redundante Prädiktoren werden nicht in die<br />

Regressionsgleichung aufgenommen<br />

Gleichung wird einfacher, kann aber trotzdem einen relativ<br />

hohen Varianzanteil erklären<br />

Schlussfolgerung:<br />

Die schrittweise Regression sollte nicht als<br />

hypothesentestendes Verfahren, sondern als ein<br />

hypothesengenerierendes Verfahren eingesetzt werden

Vergleich zweier Regressionsmodelle:<br />

Modell 1: „nachdenken“ / Modell 2: „nachdenken“ und „tanzen“<br />

<br />

Prüfen auf Signifikanz über F-Test<br />

Vergleich zwischen F emp und F krit<br />

Ergebnis:<br />

F emp > F krit<br />

Nullhypothese abgelehnt, d.h. man kann da<strong>von</strong> ausgehen, dass ein signifikanter Unterschied zwischen<br />

den zwei Regressionsmodellen besteht und somit zwischen den zwei standardisierten Beta-Gewichten.<br />

<br />

Vergleichen der jeweiligen R-Quadrat-Werte<br />

Bei der Modellzusammenfassung ist immer das Modell mit der höchsten Varianzaufklärung zu wählen<br />

(hier Modell 2).

(= Indikator-, Kategorien-, binäre oder dichotome Variablen)<br />

… sind qualitative Variablen, die keine Ordnung im mathematischen<br />

Sinne angeben.<br />

… werden verwendet, um kategoriale Merkmale in Modellen zu<br />

berücksichtigen.<br />

… nehmen nur 2 Werte an ⇒ 0 oder 1, die das Vorhandensein (1)<br />

oder Fehlen (0) eines Merkmales beschreiben.<br />

z.B.: x=1, falls Frau<br />

x=0, falls Mann<br />

Bei uns z.B. ob VP Instrument spielt:<br />

Ja = 1<br />

Nein = 0<br />

Transformation der Daten mittels<br />

Transformation der Daten mittels<br />

Transformieren Umkodieren in andere Variablen

Wirkungen im Regressionsmodell<br />

yi ˆ =<br />

b 0 +<br />

b1x1<br />

+<br />

b 2<br />

D<br />

+ 2<br />

für D=0<br />

ˆ<br />

für D=1<br />

yi = 0 + 1 1 b 2 {<br />

b<br />

b<br />

x<br />

yi ˆ =<br />

b 0 +<br />

b1x1<br />

+<br />

b 0 {<br />

b<br />

2

Im Plot sind die e i die vertikalen Abstände<br />

der Datenpunkte vom Regressionsmodell.<br />

y<br />

e<br />

k<br />

=<br />

y<br />

k<br />

−<br />

yˆ<br />

k<br />

x