Belegarbeit (.pdf - 2.3 MB) - Technische Universität Dresden

Belegarbeit (.pdf - 2.3 MB) - Technische Universität Dresden

Belegarbeit (.pdf - 2.3 MB) - Technische Universität Dresden

Sie wollen auch ein ePaper? Erhöhen Sie die Reichweite Ihrer Titel.

YUMPU macht aus Druck-PDFs automatisch weboptimierte ePaper, die Google liebt.

5. FREI VERFÜGBARE SPRACHERKENNER 36<br />

den vorhandenen Kontext. So gibt es zum Beispiel Phoneme die nur sehr selten an Wortanfängen stehen<br />

oder Phoneme die nie oder nur selten aufeinander folgen. Trotz dieser Verbesserung dauert die Spracherkennung<br />

noch zu lange. Um die Liste der möglichen Phonemkandidaten weiter zu verkleinern gibt es<br />

zusätzlich die Wortvorhersagedatenbank. Mit ihrer Hilfe werden Phoneme eliminiert, die keine gültigen<br />

Wörter ergeben. Indem man das Vokabular zusätzlich noch auf die Wörter beschränkt, die man wirklich<br />

benötigt, kann man die Erkennungsgeschwindigkeit weiter erhöhen. Sobald Phoneme erkannt sind,<br />

werden sie in Wörter geparst, in Text Strings umgewandelt und an die Anwendung weiter gegeben.[19]<br />

5.3 jlab Speech Server<br />

5.3.1 Allgemeines<br />

Der jlab Speech Server wurde im Jahre 2003 am Institut für Akustik und Sprachkommunikation (IAS)<br />

der TU <strong>Dresden</strong> entwickelt und seit dem immer weiter verbessert. Obwohl jlab unter frei verfügbare<br />

Spracherkenner aufgeführt ist, darf er nur mit Genehmigung des IAS genutzt werden und ist nur dort erhältlich.<br />

Der Erkenner arbeitet ausschließlich auf deutsch. Die Erkennung läuft sprecherunabhängig ab,<br />

wodurch ein zeitraubendes Eingangstraining für den Nutzer entfällt. Dadurch ist der jlab Speech Server<br />

ist immer sofort einsetzbar. Um die Erkennungsrate zu verbessern, sollten Wörterbücher mit den Sprachkommandos<br />

so klein wie möglich gehalten werden, so dass immer nur das minimal nötige Vokabular<br />

geladen ist. Damit keine Verzögerungen auftreten ermöglicht der jlab Speech Server einen schnellen<br />

Wechsel zwischen den Wörterbüchern.<br />

Auf Basis des jlab Speech Servers wurden unter anderem schon die Diplomarbeiten ’Sprachsteuerung<br />

eines Computerspiels - Untersuchungen zur Leistungsfähigkeit und Ergonomie’ [20] und ’Konzeption,<br />

Realisierung und Evaluation einer multimodalen Benutzungsoberfläche für PDA-basierte Software’ [22]<br />

verfasst, sowie eine Web-basierte Lernumgebung entwickelt. [27]<br />

5.3.2 Aufbau<br />

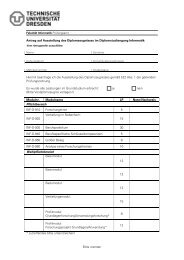

Der Grobaufbau des jlab Speech Server wird in Abbildung 5.5 gezeigt. Er kümmert sich um das Sitzungs-<br />

, Netzwerk- und Sicherheitsmanagement und bietet Dienste zur Sprachsynthese, Sprechererkennung und<br />

Spracherkennung. Im Folgenden wird es aber nur um die Spracherkennung gehen. Zum Speech Server<br />

gehört natürlich noch ein Client, der je nach Anwendung erstellt werden muss. Er ist dafür zuständig,<br />

beim Server eine neue Sitzung zu registrieren und das genutzte Vokabular, sowie alle Spracheingaben an<br />

den Server zu übermitteln. Außerdem muss er noch auf die Erkennungsergebnisse reagieren. [27]